Created at : 2025-04-10 15:49

Auther: Soo.Y

📝메모

Day1 자료

- Whitepaper Companion Podcast - Foundational LLMs & Text Generation

- Foundational Large Language Models & Text Generation | Kaggle

Large language models

거대언어모델은 단어 스퀀스의 확률을 예측한다. 일반적으로 텍스트의 접두사가 주어지면 언어 모델은 후속 단어에 확률을 계산한다. 예를 들어 “미국에서 가장 유명한 도시는…” 이라는 접두사가 주어진 언어 모델은 “뉴욕” 및 “로스앤젤레스”라는 단어에 높은 확률이 나타나고 “사과”, “노트북”와 같은 단어네느 낮은 확률을 예측한다. Transformer가 연구되기 전에는 순한 신경망(RNN)이 시퀀스 모델링에 대한 인기 있는 접근 방식이었습니다. RNN은 입력 및 출력 시퀀스를 순차적으로 처리한다. 이전 은닉 상태와 현재 입력에 따라 은닉 상태 시퀀스를 생성한다. RNN 단점으로 순차적인 계산으로 인해 병렬화하기 어렵다. 트랜스포머(Transformer)는 self-attention 메커니즘 덕분에 토큰 시퀀스를 병렬로 처리할 수 있는 신경망의 한 유형이다. 다만 트랜스포머는 컨텍스트 크기를 제한적으로 사용해야 하는 단점을 가지고 있다. 반면에 RNN은 이론적으로 무한한 컨텍스트 길이를 가질 수 있지만, 그래디언트 소실로 인해 활용하는데 어려움이 많다. 그래서 트랜스포머는 최근 몇 년 동안 거대언어모델에서 채택되고 있다.

Transformer

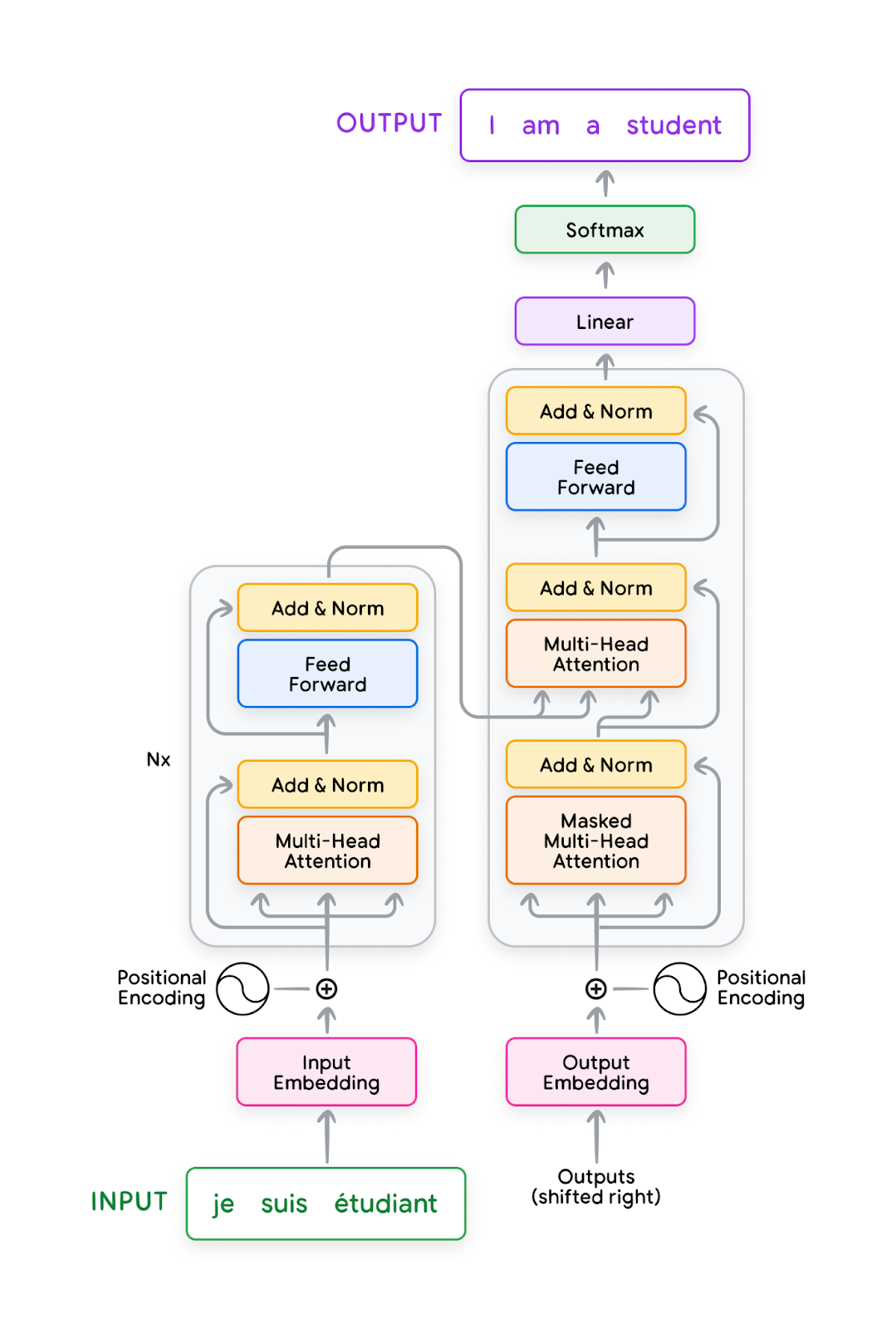

Transformer architecture은 2017년에 번역 모델 사용을 위해 구글에서 개발되었다. 초기 트랜스포머 아키텍처는 인코더와 디코더의 2 부분으로 구성되었다. 인코더는 입력 텍스트(예 프랑스어 문장)를 변환하고 변환된 값이 디코더에 전달된다. 디코더는 이 표현을 사용하여 출력 텍스트(예: 번역된 문장)를 자기 회귀적으로 생성한다. 전체적인 구조는 아래 그림과 같다.

트랜스포머는 여러 계층으로 구성된다. 신경망의 계층은 데이터에 특정 변환을 수행하는 매개변수의 집합으로 구성된다. 그림에서 볼 수 있듯이 Multi-Head Attention, Add & Norm, Feed-Forward, Linear, Softmax 등 여러 계층이 포함되어 있다. 계층은 입력, 숨겨진 및 출력 계층으로 세분화할 수 있다.

Input preparation and embedding

트랜스포머를 위한 언어 입력을 준비하기 위해서 입력 시퀀스를 토큰으로 변환한 다음 입력 임베딩으로 변환한다. 입력 입베딩을 생성하는 과정에는 다음과 같은 단계가 포함된다.

- 정규화(선택사항) : 불필요한 공백, 악센트 등을 제거하여 텍스트를 표준화한다.

- 토큰화 : 문장을 단어 또는 서브웓드로 나누고 어휘에서 정수 토큰 ID로 매팅한다.

- 임베딩 : 각 토큰 ID를 해당 고차원 벡터로 변환하며, 일반적으로 룩업 데이터를 사용한다. 이러한 벡터는 훈련 과정에서 학습된다.

- 위치 인코딩 : 스퀀스에서 각 토큰의 위치에 대한 정보를 추가한다.

Multi-head attention

입력 토큰을 임베딩 벡터로 변환한 후, 이 임베딩을 다중 헤드 어텐션 모듈에 입력한다. self-attention은 트랜스포머에서 중요한 메커니즘이다. 입력 시퀀스의 특정 부분에 집중하고, 기존의 RNN보다 스퀀스 내의 장거리 의존성을 더 효과적으로 포착할 수 있다.

Understanding self-attention

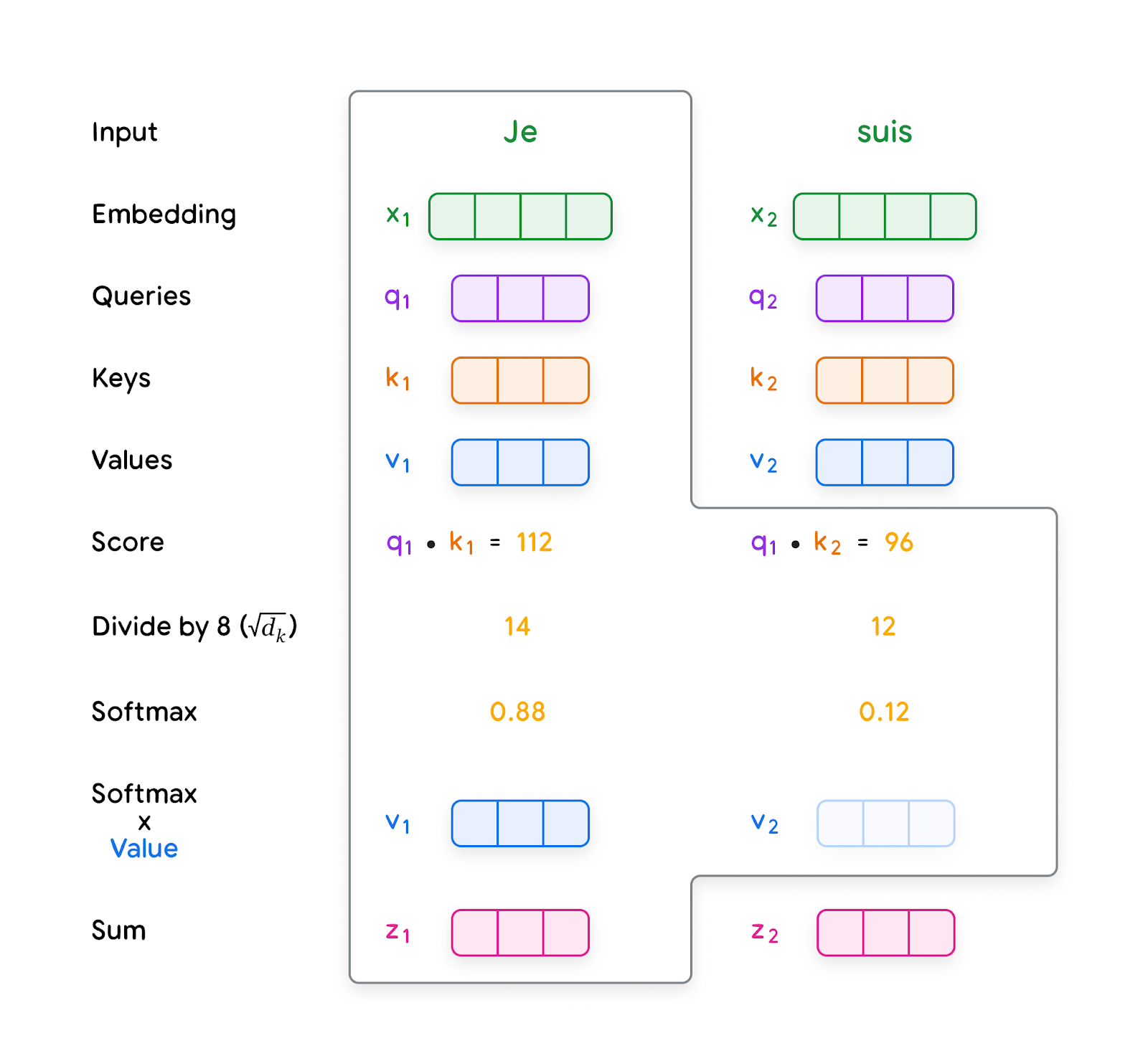

다음 문장을 예시로 사용해보자. “The tiger jumped out of a tree to get a drink because it was thirsty.” self-attention은 문장에서 단어와 구절 간의 관계를 파악하는데 도움이 된다. 예를 들어 이 문장에서 “tiger”와 “it”은 동일한 객체이므로 이 두 단어는 강하게 연결되어 있을 것으로 예상된다. self-attention는 다음 단계를 통해 이를 달성한다.

-

쿼리(Query), 키(Key), 값(Value)을 생성한다. 입력 임베딩 각각은 학습된 가중치 행렬 3개(Wq, Wk, Wv)에 곱하여 Q, K, V 벡터를 생성한다. 이들은 각 단어의 전문화된 표현과 유사하다.

- 쿼리 : 쿼리 벡터는 모델이 “어떤 다른 단어들이 저에게 관련이 있습니까?”라는 질문을 던지는데 도움이 된다.

- 키 : 키 벡터는 모델이 스퀀스에서 단어가 다른 단어와 어떻게 관련될 수 있는지 식별하는 데 도움이 되는 레이블과 같다.

- 값 : 값 벡터는 실제 단어 내용 정보를 보유 한다.

-

점수 계산 : 점수는 각 단어가 다른 단어에 얼마나 ‘주의’해야 하는지를 결정하기 위해 계산된다. 이는 한 단어의 쿼리 벡터를 시퀀스의 모든 단어의 키 벡터와 내적함으로써 수행된다.

-

정규화 : 안정성을 위해 키 벡터 차원(dk)의 제곱근으로 점수를 나눈 다음 소프트맥스 함수를 통해 attention 가중치를 얻는다. 이러한 가중치는 각 단어가 다른 단어와 얼마나 강하게 연결되어 있는지 의미한다.

-

가중치 부여된 값 : 각 Value 벡터는 해당 어텐션 가중치와 곱해진다. 그 결과는 더해 각 단어에 대한 문맥 인식 표현을 생성한다.

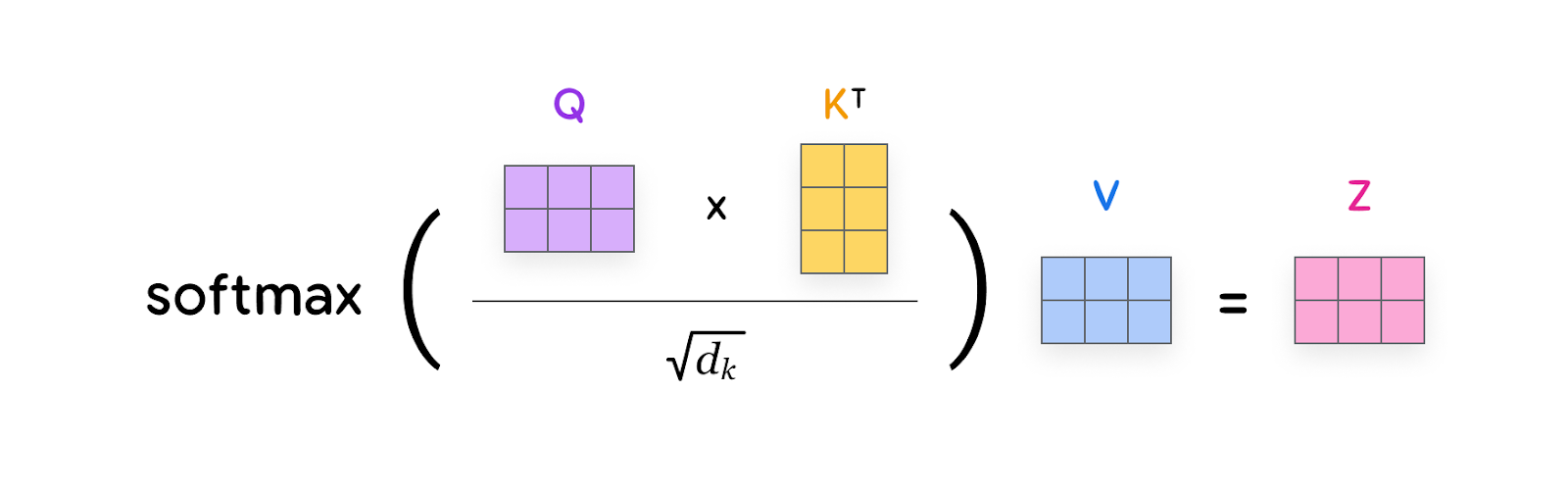

실제로는 쿼리, 키, 값 벡터를 아래 그림과 같이 모든 토큰에 대해 Q, K, V 행렬로 만들고 동시에 계산이 수행된다.

Multi-head attention: power in diversity

Multi-head attention은 여러 개의 Q, K, V 가중치 행렬 세트를 사용한다. 이들은 병렬로 실행되며, 각 ‘헤드(Head)‘는 입력 관계의 서로 다른 측면에 집중할 수 있다. 각 헤드에서 출력된 값은 연결되고 선형변형되어 모델에 입력 시퀀스의 풍부한 표현을 제공한다. Multi-head attention의 사용은 모델의 복잡한 언어 패턴 및 장거리 종속성을 처리하는 능력을 향상시킨다. 이는 기계 번역, 텍스트 요약, 질의 응답과 같은 미묘한 언어 구조 및 내용 이해가 필요한 작업에 매우 중요하다. 이 메커니즘은 트랜스포머가 입력의 여러 해석 및 표현을 고려할 수 있도록 한다.

Layer normalization and residual connections

트랜스포머의 각 레이어는 Multi-head attention 모듈과 feed-forward 레이어로 구성되며, 레이어 정규화(Layer normalization)와 잔차 연결(residual connections)을 사용한다. 레이어 정규화는 주어진 레이어의 활성화를 정규화하기 위해 활성화 함수의 평균과 분산을 계산한다. 이는 일반적으로 covariate shift를 줄이고 학습 중 더 빠른 수렴을 달성하고 전반적인 성능을 향상시키기 위해 수행한다.

Feedforward layer

Multi-head attention 모듈과 이후의 Add and Norm 레이어의 출력은 각 트랜스포머 블록의 feed-forward 레이어로 전달된다. 이 레이어는 시퀀스 내의 각 위치에 대해 독립적으로 데이터에 위치별 변환을 적용하여 모델 표현에 추가적인 비선형성과 복잡성을 통할할 수 있게 해준다. Feed-forward layer는 일반적으로 ReLU 또는 GELU와 같은 비선형 활성화 함수와 함께 2개의 선형 변환으로 구성된다. Feed-forward 레이어 처리 후 데이터는 또 다른 ‘Add and Norm’ 단계를 거치며, 트랜스포머 모델의 안정성과 효율성을 기여한다.

Encoder and decoder

원래 트랜스포머 아키텍처는 인코더와 디코더 모듈의 조합으로 구성된다. 각 인코더 및 디코더는 일련의 레이어로 구성되며, 각 레이어는 핵심 구성 요소인 멀티 셀프 어텐션 메커니즘, 위치별 피드 포워드 네트워크, 정규화 레이어 및 잔차 연결을 포함한다.

인코더의 주요 기능은 입력 시퀀스를 각 토큰에 대한 문맥 정보를 유지하면서 연속적인 표현으로 처리한다. 입력 시퀀스는 먼저 정규화, 토큰화 과정을 통해 임베딩으로 변환된다. Self-attention 메커니즘을 통해 시퀀스 내의 각 토큰은 다른 모든 토큰에 동적으로 주의를 기울여 시퀀스 내의 문맥 관계를 이해할 수 있게 된다.

디코더는 인코더의 출력 벡터 Z가 제공하는 컨텍스트를 기반으로 출력 시퀀스를 생성하는 역할을 한다. 디코더는 시작 토큰을 시작으로 토큰 단위로 하나씩 생성해 나간다. 디코더 레이어는 두 가지 종류의 어텐션 메커니즘을 사용한다.

- 마스킹된 자기 어텐션(masked self-attention)

- 현재 위치의 토큰은 출력 시퀀스에서 앞쪽에 있는 토큰들만 참조할 수 있도록 제한한다.

- 이렇게 해야 오토레그레시브(auto-regressive) 속성을 지킬 수 있다.

- 즉, 미래 토큰을 미리 알지 못하게 하여 예측이 올바르게 이루어지도록 한다.

- 인코더-디코더 교차 어텐션(encoder-decoder cross-attention)

- 디코더가 인코더가 만든 입력 시퀀스의 문맥 임베딩(contextual embeddings)을 참조할 수 있게 한다.

- 이를 통해 입력 내용 중 중요한 부분에 집중하여 더 정확한 출력을 생성한다.

이러한 과정을 반복적으로 수행하면서 디코더는 토큰을 하나씩 생성하고, 마지막에는 종료 토큰(end-of-sequence token)을 생성하면서 출력 시퀀스를 완성한다.

Mixture of Experts(MoE)

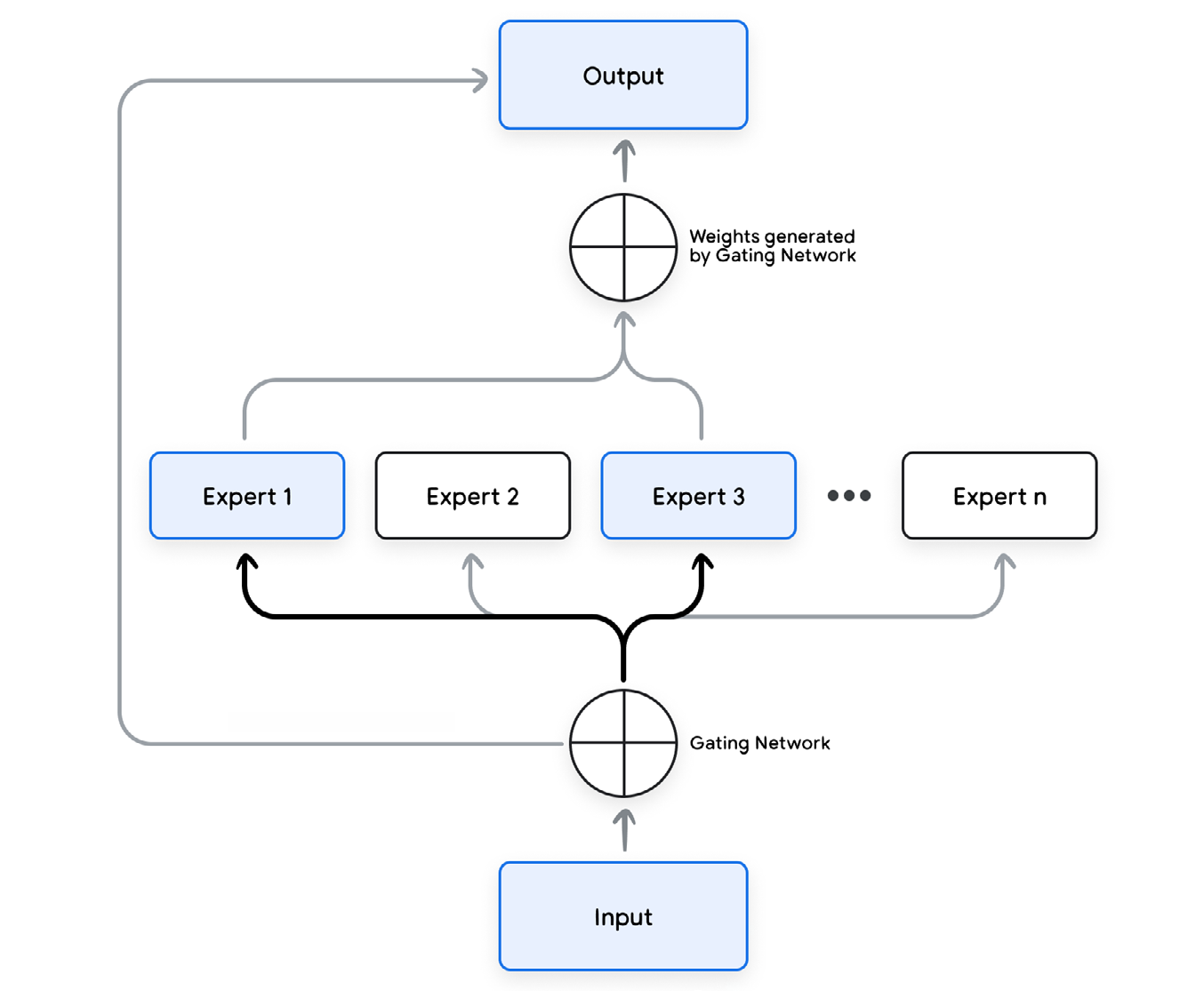

Mixture of Experts(MoE)는 여러 개의 전문화된 서브모델을 결합하여 전체적인 성능을 향상시키는 아키텍쳐이다. 특히 복잡한 작업에서 뛰어난 성능을 발휘한다. MoE는 앙상블 학습의 한 형태이지만, 중요한 차이점이 하나 있다. 단순히 모든 전문가의 예측을 평균내는 것이 아니라, 입력의 서로 다른 부분을 서로 다른 전문가에게 전달하도록 학습한다는 점이다. 이로 인해 모델은 특정 하위 영역(sub-domain)이나 데이터의 특정 측면에 대해 각각의 전문가가 전문화할 수 있다.

전문가(Experts)

- 각각의 서브모델로, 입력 데이터의 특정 부분이나 특정 작업을 처리하도록 설계되어 있다. 이 모델들은 신경망, 의사결정트리 등 다양한 형태일 수 있지만, 대형 언어 모델에서는 보통 트랜스포머 기반으로 구성된다.

게이팅 네트워크(Gating Network 또는 라우터 Router)

- 입력을 적절한 전문가에게 전달하는 역할을 하는 매우 중요한 구성 요소이다. 이 네트워크는 입력을 받아서 전문가들에 대한 확률 분포를 출력한다. 이 확률은 각 전문가가 최종 예측에 얼마나 기여할지를 결정한다. 이 게이팅 네트워크 또한 보통은 신경망으로 구성한다.

결합 메커니즘(Combination Mechanism)

- 전문가들의 출력을 게이팅 네트워크가 제공한 확률 가중치로 결합하여 최종 예측을 생성한다. 일반적으로 가중 평균 방식이 사용된다.

실제로 MoE 아키텍처는 전문가라고 불리는 여러 개의 전문화된 서브모델을 결합하여 복잡한 작업을 처리한다. 단순히 모든 전문가의 예측을 평균내는 것이 아니라 MoE는 게이팅 네트워크를 사용하여 입력의 각 부분을 가장 적절한 전문가에게 적절히 분배한다.

입력은 전문가들과 게이팅 네트워크 모두에게 전달된다.

- 각 전문가는 입력을 받아 자체적으로 처리하고 출력을 생성한다.

- 동시에 게이팅 네트워크는 입력을 분석하여 전문가별 확률 분포를 생성한다. 이 확률은 각 전문가가 최종 결과에 얼마나 기여할지를 나타낸다.

이렇게 계산된 확률은 전문가들의 출력에 가중치로 적용되고, 가중 합(Weighted combination)이 최종 예측 결과가 된다. 이 방식은 각각의 전문가가 특정 종류의 데이터나 하위 작업에 특화될 수 있게 하며 모델의 전반적인 성능을 향상시키는 데 도움이 된다. 또한 희소 활성화(sparse activation)를 통해 하나의 입력에 대해 일부 전문가만 활성화되도록 하여 계산 비용(computational cost)도 절감할 수 있다.

Large Reasoning Models

대규모 모델에거 강력한 추론 능력을 달성하는 것은 매우 복잡한 작업이며, 이를 위해서는 모델 구조 설계, 훈련 방법, 그리고 프롬프트 전략의 조합이 필요하다.

고급 프롬프트 전략들

- Chain-of-Thought(CoT)

- 모델이 최종 답을 내기 전에 중간 추론 단계를 생성하도록 유도한다.

- 프롬프트에 단계별 추론 예시를 제공하여, 모델이 복잡한 문제를 작은 하위 문제로 나누어 해결하도록 학습한다.

- 이는 사람의 사고 과정을 모방하며, 다단계 추론(multi-step inference)이 필요한 작업에서 성능을 크게 향상시킨다.

- Tree-of-Thoughts(ToT)

- 여러 추론 경로를 탐색하고, 탐색 알고리즘(search algorithm)을 사용하여 가장 유망한 해결책을 찾는다.

- 특히 게임 트리나 조합적 문제(combinatiorial problems)에 유용하다.

- Least-to-Most

- 쉬운 하위 문제부터 점점 더 어려운 문제로 확장해 나가는 방식이다.

- 앞선 하위 문제의 출력 결과를 다음 문제의 프롬프트에 포함시켜 점진적인 문제 해결을 유도한다.

모델 훈련 기법(Training Methodologies) 추론 전용 데이터셋으로 파인튜닝(Fine-tuing)

- 논리 퍼즐, 수학 문제, 상식 기반 추론 문제 등이 포함된 전용 데이터셋으로 모델을 추가 훈련한다.

지시 기반 튜닝(Instruction Tuning)

- 자연어로 된 명령어를 따르도록 모델을 학습시켜 복잡한 추론 요청에 잘 반응하도록 만든다. 인간 피드백 기반 강화 학습(Reinforcement Learning from Human Feedback, RLHF)

- 사람의 피드백을 바탕으로 모델의 출력을 개선한다.

- 추론 능력뿐만 아니라 유용성(helpfulness)과 일관성(coherence)도 향상된다.

지식 증류(Knowledge Distillation)

- 더 큰 성능을 가진 교사 모델(teacher)의 지식을 더 작도 효율적인 학생 모델(stduent)에 전이한다.

- 이를 통해 계산 자원은 줄이면서도 추론 능력을 유지할 수 있다.

추론 시의 기법들(Inference Techniques)

- 빔 서치(Beam Search) : 여러 후보 출력을 동시에 탐색하여, 더 나은 추론 결과를 선택한다.

- 온도 조절(Temperature Scaling) : 출력의 무작위성(randomness)을 조절하여 탐헝과 이용(exploration vs exploitation) 사이의 균형을 맞춘다.

외부 지식 통합(External Knowledge Integration)

- 지식 그래프(knowledge graph)나 구조화된 데이터베이스 같은 외부 지식을 활용하여, 모델의 추론 과정에 추가적인 정보를 제공한다.

- 대표적인 기법은 Retrieval-Augmented Generation(RAG)으로 출력을 생성하기 전에 관련 정보를 검색해서 모델에게 제공하는 방식이다.

Training the transformer

머신러닝 모델에 대해 이야기할 때 훈련(training)과 추론(inference)을 구분하는 것은 매우 중요하다.

- 훈련 : 보통 모델의 파라미터(매개변수)를 수정하는 과정이다.

- 추론 : 예측된 출력을 얻기 위한 과정으로 모델의 가중치는 변경되지 않는다.

이제부터 트랜스포머 훈련에 대해서 설명하고자 한다.

Data preparation

트랜스포머 모델 훈련의 첫 번째 단계는 데이터 준비(Data preparation)이며, 이 과정 자체도 몇 가지 중요한 단계로 구성되어 있다.

-

데이터 정제(Cleaning the Data)

- 필터링 : 불필요하거나 품질이 낮은 데이터 제거

- 중복 제거 : 중복된 데이터를 제거

- 정규화 : 데이터 포맷을 일관되게 맞추기(예: 대소문자 통일, 공백 제거 등)

-

토크나이징(Tokenization)

- 데이터셋을 토큰이라는 작은 단위로 나누는 과정

- 대표적인 방법에는 Byte-Pair Encoding(BPE), Unigram Tokenization 등이 있다.

- 이 과정을 통해 어휘 집합(vocabulary)이 생성된다.

-

데이터셋 분할(Dataset Splitting)

- 훈련 데이텃과 테스트 데이터셋으로 분할한다.

Training and loss function

훈련 과정 요약

- 훈련 데이터셋에서 입력 시퀀스 묶음(batch)을 샘플링한다.

- 비지도 사전학습에서는 목표 시퀀스가 입력 시퀀스 자체로부터 생성된다.

- 입력 시퀀스 묶음은 트랜스포머에 입력된다.

- 예측된 시퀀스와 목표 시퀀스 간의 차이는 보통 크로스 엔트로피 손실 함수(cross-entropy loss) 를 사용하여 계산된다.

- 손실(loss)의 기울기(gradient)가 계산되고 최적화 알고리즘(optimizer)이 기울기를 이용하여 트랜스포머의 파라미터를 업데이트한다.

- 이 과정을 반복하여 트랜스포머가 일정한 성능에 도달하거나 사전에 지정한 토큰 수 만큼 훈련이 진행될 때까지 계속된다.

아키텍처별 훈련 방식

1. 디코더 전용 모델(Decoder-only models)

- 주로 언어 모델링 작업에 사전 훈련된다.

- 목표 시퀀스는 입력 시퀀스의 한 칸 이동된 버전이다.

예를 들어 훈련 시퀀스가 the cat sat on the mat이라면:

| 입력 시퀀스 | 예측해야 할 목표 |

|---|---|

| the cat sat on | the |

| the cat sat on the | mat |

이렇게 다양한 입력/출력 쌍을 생성할 수 있다.

2. 인코더 전용 모델(Encoder-only models, 에 BERT)

- 입력 시퀀스를 일부 훼손(corrupt)시키고 모델이 이를 복원(reconstruct)하도록 훈련한다.

- 대표적인 방식은 마스킹 언어 모델링이다.

예시

- 입력:

The [MASK] sat on the mat - 목표 시퀀스:

The cat sat on the mat

3. 인코더-디코더 모델(Encoder-Decoder models, 에: 태초의 Transformer)

- Sequence-to-sequence 작업에 사용되며 감독 학습(supervised) 방식으로 훈련된다.

- 예시 작업들:

- 번역: 입력 →

Le chat est assis sur le tapis, 목표 →The cat sat on the mat - 질문-답변: 입력 → 질문, 목표 → 답

- 요약: 입력 → 긴 기사, 목표 → 요약문

- 번역: 입력 →

- 또한, 위키백과처럼 일반 텍스트를 이용해 비지도 방식으로도 학습시킬 수 있습니다.

예: 입력 → 문서 앞부분, 목표 → 뒷부분

4. 추가 고려 사항: 컨텍스트 길이(Context Length)

- 컨텍스트 길이란, 모델이 다음 토큰을 예측할 때 이전의 몇 개 토큰까지 기억하고 사용할 수 있는지를 말한다.

- 컨텍스트가 길수록 복잡한 관계나 문맥 정보를 더 잘 포착할 수 있어 성능 향상에 도움이 된다.

- 하지만 길이가 길수록 연산량과 메모리 사용량이 증가하여, 훈련 및 추론 속도가 느려질 수 있다.

- 따라서 작업의 특성과 사용 가능한 자원을 고려하여 적절한 컨텍스트 길이를 균형 있게 선택해야 한다.

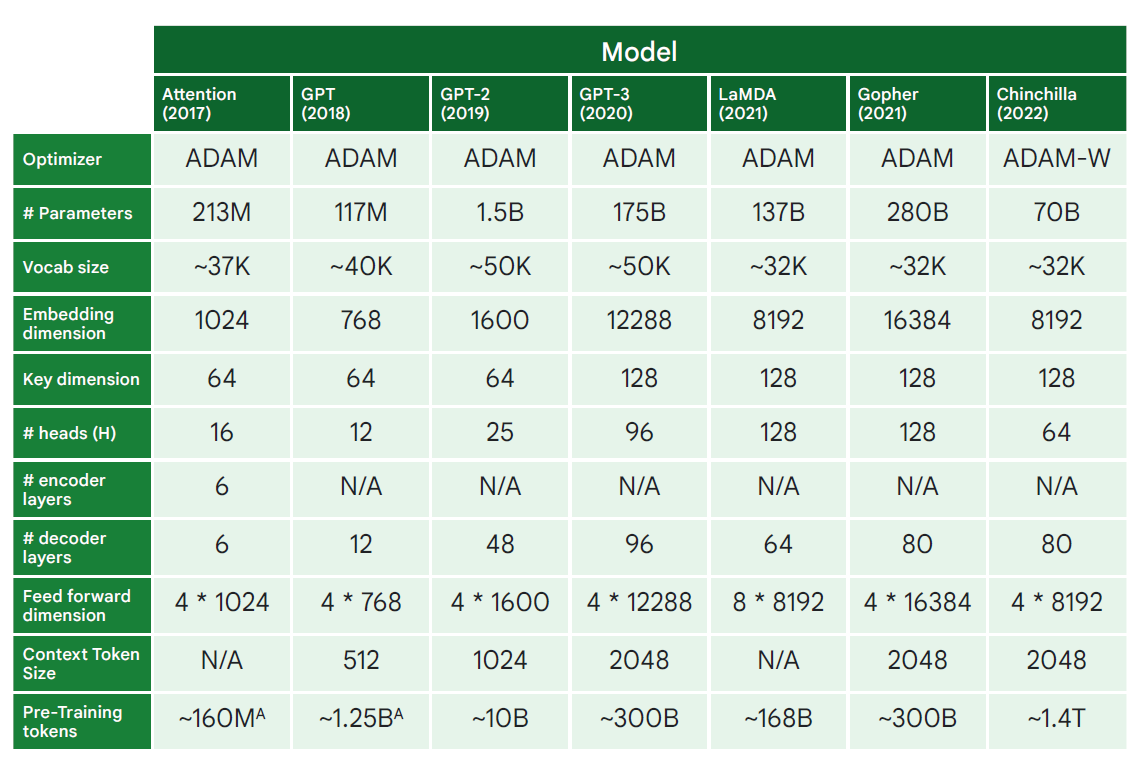

The evolution of transformers

이번 섹션은 다양한 트랜스포머 아키텍처에 대한 개요입니다. GPT-1과 BERT로부터 시작하여 마지막에는 Google의 최신 대형 언어 모델 시리즈인 Gemini까지 살펴볼 예정이다.

BERT

BERT는 Bidirectional Encoder Representations from Transformers의 약자로 전통적인 인코더-디코더 트랜스포머 모델들과는 달리, 인코더 전용(encoder-only) 아키텍처이다.

핵심 특징 BERT는 문장을 생성하거나 번역하는 것이 아니라, 문맥을 깊이 있게 이해나는 데 초점을 맞추고 있다. 이를 위해 마스킹 언어 모델이라는 학슴 목표를 사용한다.

마스킹 언어 모델

- 문장에서 무작위 단어를 [MASK] 토큰으로 바꾸고, BERT는 양쪽 문맥을 보고 원래 단어를 예측한다.

이 방식은 단어의 왼쪽과 오른쪽 문맥을 동시에 고려하게 하므로, 기존 트랜스포머보다 더 정밀한 문맥 이해가 가능하다.

다음 문장 예측 BERT는 또 다른 훈련 목표로 NSP를 사용한다.

- 두 문장이 주어졌을 때, 두 번째 문장이 첫 번째 문장 뒤에 실제로 이어지는 문장인지를 판단하게 한다. 이러한 방식으로 BERT는

- 단어 수준에서 양방향 문맥을 이해할 수 있게 되었다.

- 문장 간 관계를 파악할 수 있게 된다.

활용 분야 이러한 능력 덕분에 BERT는 특히 다음과 같은 자연어 이해(NLU) 작업에서 뛰어난 성능을 보인다.

- 질문-답변(Question Answering)

- 감정 분석(Sentiment Analysis)

- 자연어 추론(Natural Language Inference) 등

BERT의 한계

- 인코더 전용 모델이기 때문에 BERT는 텍스트 생성 기능은 없다.

GPT-1

GPT-1(Generative Pre-trained Transformer 버전 1)은 OpenAI가 2018년에 개발한 디코더 전용 모델이다. 이 모델은 BooksCorpus라는 데이터셋을 기반으로 학습되었고 텍스트 생성, 언어 번역, 창의적인 콘텐츠 작성, 정보성 질문 응답 등 다양한 작업을 수행할 수 있다.

GPT-1의 주요 혁신

1. 트랜스포머 + 비지도 사전학습의 결합

- 비지도 사전학습은 레이블이 없는 대규모 텍스트 데이터를 사용해 먼저 언어 모델을 훈련한 후, 특정 작업(예: 번역, 감정 분석 등)을 위해 감독 학습으로 미세 조정하는 방식이다.

- 이전에는 대부분의 언어 모델이 감독 학습 방식으로만 훈련되었고, 이에는 2가지 문제점이 있었다.

- 레이블이 붙은 데이터(labeled data)를 대량으로 수집해야 하는데, 이건 비용과 시간이 많이 든다.

- 모델은 훈련에 사용된 작업과 유사한 작업에만 일반화할 수 있다.

- 반면, 비지도 사전학습 + 감독 미세 조정의 조합은 더 나은 성능을 보여주었다. 대표 사례 중 하나가 Semi-supervised Sequence Learning이다.

2. BooksCorpus 데이터셋의 사용

- GPT-1은 약 5GB 규모의 레이블 없는 텍스트로 구성된 BooksCorpus 데이터셋으로 학습되었다.

- 이 데이터셋은 7,000권 이상의 미출간 책을 포함하고 있어 다양한 문맥과 긴 문장을 학습하는데 적합하다.

- 연속적인 문장 구조가 많아, 장기 의존성을 배우는 데도 효과적이다.

3. 작업 인식형 입력 변환(Task-aware Input Transformations) GPT-1은 특정 작업을 위한 구조화된 입력을 프롬프트 구조로 단순히 변환해서 처리할 수 있음을 보여주었다. 이는 작업별 아키텍처 없이도 다양한 NLP 작업에 대응할 수 있게 해주었다.

예:

- 텍스트 함의(Textual Entailment)

→ 전제(premise)와 가설(hypothesis)을 구분자

$로 연결:[p, $, h] - 질문-답변(Question Answering)

→ 문맥(context) + 질문(question) + 답변(answer)을 다음과 같이 연결:

[c, q, $, a]

4. 성능 및 한계

- GPT-1은 여러 벤치마크에서 기존 모델을 능가하며 우수한 성능을 보였다.

- 그러나 몇 가지 제한점도 있었다.

- 반복적인 문장을 생성하는 경향이 있음

- 다중 턴 대화에서는 일관된 추론이 어려움

- 긴 문장이나 단락에서는 문맥 연결성이 부족

- 짧은 시퀀스에서는 유창하지만, 긴 시퀀스에서는 일관성이 떨어짐

GPT-2

GPT-2는 GPT-1의 후속 모델로 2019년 OpenAI에서 발표되었다. GPT-2의 가장 큰 혁신은 바로 직접적인 스케일 업이었다. 즉, 모델의 파라미터 수와 학습 데이터의 크기가 약 10배 증가했다.

주요 특징

- 데이터

- GPT-2는 40GB에 달하는 대규모이자 다양한 데이터셋인 WebText로 학습되었다.

- WebText는 Reddit에서 카르마 점수(Karma)가 3 이상인 게시글들을 바탕으로 수집한 약 4,500만 개 웹페이지로 구성되어 있다.

- 카르마 점수는 Reddit의 품질 지표이며, 점수 3 이상은 합리적인 품질 수준을 의미한다.

- 파라미터 수

- GPT-2는 15억 개(1.5B)의 파라미터를 갖고 있으며, 이는 GPT-1보다 10배 이상 큰 규모이다.

- 연구팀은 다음과 같은 파라미터 수를 가진 4가지 모델을 실험했다.

- 117M(GPT-1)

- 345M

- 762M

- 1.5B(GPT-2)

- 그 결과 파라미터가 클수록 다양한 작업에서 더 나은 성능을 보였다.

성능 및 장점

- GPT-2는 GPT-1보다 더 일관성 있고 현실감 있는 텍스트 생성이 가능했다.

- 자연어 처리 작업에서 창작, 번역, 문장 생성 등의 도구로 유용하게 활용되었다.

- 특히 GPT-2는 다음 분야에서 현저한 개선을 보였다.

- 장기 의존성 포착 능력

- 상식 추론

제한 사항

- 다만, GPT-2는 일부 작업(예: 톡해, 요약, 번역)에서 최신 최고 성능(state-of-the-art) 모델을 완전히 능가하지는 못했다.

Zero-shot 학습의 돌파구 GPT-2의 가장 큰 성과 중 하나는 제로샷 학습 능력이다.

- 제로 샷 학습이란, 별도의 훈련 없이 모델이 새로운 작업을 일반화하여 수행하는 능력이다.

- 이때 모델은 주어진 프롬프트나 지시어만으로 작업을 이해해야한다.

예를 들어: 영어 문장 다음에 “German :” 이라는 프롬프트가 주어지면, 모델은 이것이 영어 → 독일어 번역 작업임을 추론하고 독일어 번역문을 생성한다. GPT-2는 이렇게 다음 작업들을 명시적인 감독 없이도 수행할 수 있었다.

- 기계 번역

- 요약

- 독해

제로샷 성능과 모델 용량의 관계

- 연구 결과, 모델의 용량이 커질수록 제로샷 작업에서의 성능은 로그-선형 관계로 향상된다는 사실이 밝혀졌다.

- GPT-2는 더 큰 데이터셋과 더 많은 파라미터로 학습할수록 작업을 이해하고 수행하는 능력이 향상된다는 것을 보여주었다.

GPT-3/3.5/4

GPT-3는 세 번째 버전의 GPT 모델로 GPT-2와 비교해 규모, 능력, 유연성 면에서 획기적인 진화를 이뤘다.

GPT-3

1. 압도적인 규모 차이

- GPT-3 : 175B(1750억 개 파라미터)

- GPT-2 : 1.5B(15억 개 파라미터)

- GPT-3의 이 엄청난 규모 덕분에, 모델은 더 많은 정보를 저장하고 회상할 수 있고 더 정교한 명령어를 이해하며, 더 일관성 있고 맥락에 맞는 텍스트를 긴 문장에서도 생성할 수 있게 되었다.

2. Few-shot, Zero-shot 수행 능력

- GPT-2는 특정 작업을 잘 수행하려면 추가 훈련 데이터로 파인튜닝이 필요했다.

- 하지만 GPT-3는 몇 개의 예시만 보여주거나(Few-shot), 아예 예시 없이 지시문만으로도 작업을 이해하고 수행할 수 있다.(Zero-shot)

- 이는 GPT-3가 더 유연하고 동적인 문제 해결 능력을 갖추었다는 것을 의미하며, 작업별 파인튜닝의 필요성을 줄여준다.

3. 더 넓은 범용성(Generallzation) GPT-3는 그 거대한 파라미터 수와 다양한 학습 데이터 덕분에, 번역, 질문 응답, 글쓰기 등 다양한 자연어 처리 작업에서 기본 상태 그대로도 뛰어난 성능을 보인다.

InstructGPT(GPT-3 기반 파인튜닝 모델)

- InstructGPT는 GPT-3에 지시문을 따르는 능력을 강화하기 위해 개발된 버전이다.

- 사람의 시범을 담을 데이터로 감독 학습을 진행한 후, 그 결과물을 사람이 평가하고 이를 바탕으로 인간 피드백 기반 강화학습을 적용한다.

- 이로 인해 모델은 더 잘 지시를 따르고, 더 정확하고 진실된 다변을 내며, 유해성도 줄었다.

- 놀랍게도, 파라미터 수가 13억 밖에 안되는 InstructGPT가 175B짜리 GPT-3보다 사람 평가에서 더 좋은 결과를 보였다.

GPT-3.5 & GPT-3.5 Turbo

- GPT-3.5는 GPT-3보다 더 발전된 성능을 가지고 있으며, 특히 코드를 이해하고 생성하는 능력이 향상되었다. 또한 대화형 최적화가 되어 있어 챗봇에 적합하다.

- 문맥 길이

- 입력 최대 : 16,385 토큰

- 출력 최대 : 4,096 토큰

GPT-4

GPT-4는 GPT-3.5의 연장선상에 있는 대형 멀티모달(Multimodal)이다.

멀티모달 처리

- 텍스트 + 이미지르 입력으로 받고, 텍스트 출력을 생성할 수 있다.

성능 및 특징

- 더 넓은 일반 상식

- 고급 추론 능력

- 다양한 분야에서 복잡한 작업 수행 가능

- 수학, 프로그래밍, 시각 정보 해석, 의학, 법률, 심리학 등

- 문맥 길이 입력 최대 : 128,000 토큰

- 문맥 길이 출력 최대 : 4,096 토큰

GPT-4는 때때로 인간 이상의 성능을 보이며, 이전 모델(GPT-3.5 포함)을 상당히 능가하는 결과를 보여준다.

LaMDA

LaMDA는 Google이 개발한 Language Model for Dialogue Applications의 약자로, 대규모 언어 모델 분야에 대한 또 다른 기여이며, 특히 자유로운 대화를 중심으로 설계된 모델이다.

전통적인 챗봇과의 차이점 기존의 챗봇은 보통 제한된 주제나 미리 정의된 범위 내에서 작동하지만, LaMDA는 다양한 주제를 폭넓게 다룰 수 있도록 설계되었다. 이를 통해 보다 자연스럽고 유창한 대화를 가능하게 한다.

훈련 방식 및 목적

- LaMDA는 대화 중심의 데이터로 훈련되었다.

- 이는 단순히 단답형 응답을 생성하는 것이 아니라, 대화를 계속 이어갈 수 있도록 하는 데 초점을 맞추게 된다.

- 사용자가 모델과 심화되고 탐구적인 대화를 나눌 수 있도록 설계되었다.

GPT 모델과의 비교

- GPT 시리즈는 텍스트 생성, 코드 작성 등 다양한 작업을 동시에 수행하는 능력을 강조한다.

- 반면 LaMDA는 대화의 깊이와 흐름 유지에 더 집중한다.

- GPT는 긴 글 작성과 다중 작업 처리에 강점을 보이며, LaMDA는 사람처럼 예측 불가능하고 풍부한 대화 흐름을 모방하는 데에 초점을 둔다.

Gopher

Gopher는 2021년에 DeepMind가 개발한 디코더 전용 트랜스포머 기반의 2800억 개 파라미터를 가진 대형 언어 모델이다. 이 모델은 다음과 같은 작업들을 수행할 수 있다.

- 텍스트 번역

- 언어 번역

- 다양한 형태의 창작 콘텐츠 작성

- 질문에 대한 정보성 응답 제공

주요 특징

1. 데이터셋 품질 향상 - MassiveText라는 고품질의 텍스트 데이터셋을 사용 - 총 10TB, 24.5억 개 문서 포함 (출처: 웹페이지, 책, 뉴스, GitHub 코드 등) - 학습에는 전체 데이터의 12%(3000억 토큰)만 사용됨 - 데이터 품질을 높이기 위해 다음과 같은 정제 작업을 수행함 - 중복된 텍스트 제거 - 유사한 문서 제거

2. 최적화 기법

- 1,500 스텝 동안 학습률 워밍업을 사용하고 이후에는 코사인 스케줄로 학습률 감소

- 모델 크기가 커질수록 학습률은 낮추고, 배치당 토큰 수는 늘리는 전략을 사용

- 그래디언트 클리핑(gradient clipping)도 적용

- 전체 그래디언트 노름(global gradient norm) 기준으로 최대 1로 제한

- 훈련 안정성 향상에 도움

3. 평가 결과 Gopher는 수학, 상식, 논리 추론, 과학 지식, 윤리, 독해 등 다양한 작업에서 평가되었고 그 중 81%의 작업에서 기존 최고 성능 모델을 능가했다.

- 지식 기반 작업에서 강한 성능

- 그러나 추론 기반 작업에서는 어려움을 보임

4. 모델 크기와 성능 관계

- 연구진은 모델 크기가 다양한 작업에 어떤 영향을 미치는지 실험했다.

- 논리 추론과 독해에는 파라미터 수 증가가 큰 성능 향상으로 이어짐

- 반면, 일반 상식처럼 단순한 작업에는 모델 크기를 늘려도 성능 향상이 거의 없음(점차 정체)

GLaM

GLaM은 Google이 개발한 Generalist Language Model로 최초의 회소 활성화(sparsely-activated) Mixture-of-Experts 언어 모델이다.

Mixture-of-Experts 기반 모델의 특징

- Mixture-of-Experts(MoE) 기반 모델은 전체 파라미터 수가 매우 크더라도, 입력 토큰마다 일부 전문가(expert)만 활성화되므로 계산 효율이 매우 뛰어났다.

GLaM의 성능 및 효율

- 총 파라미터 수 : 1.2조(1.2 trillion)

- 하지만 한 번의 입력 토큰 처리 시에는 일부 파라미터(전문가들)만 사용되므로, 전체 모델을 모두 사용하는 것보다 훨씬 효율적이다.

결과적으로 GLaM은

- GPT-3 훈련에 사용된 에너지의 1/3만 사용

- GPT-3 추론 시 필요한 FLOPs의 절반만 사용

- 그럼에도 불구하고 GPT-3보다 더 나은 성능을 달성

Chinchilla

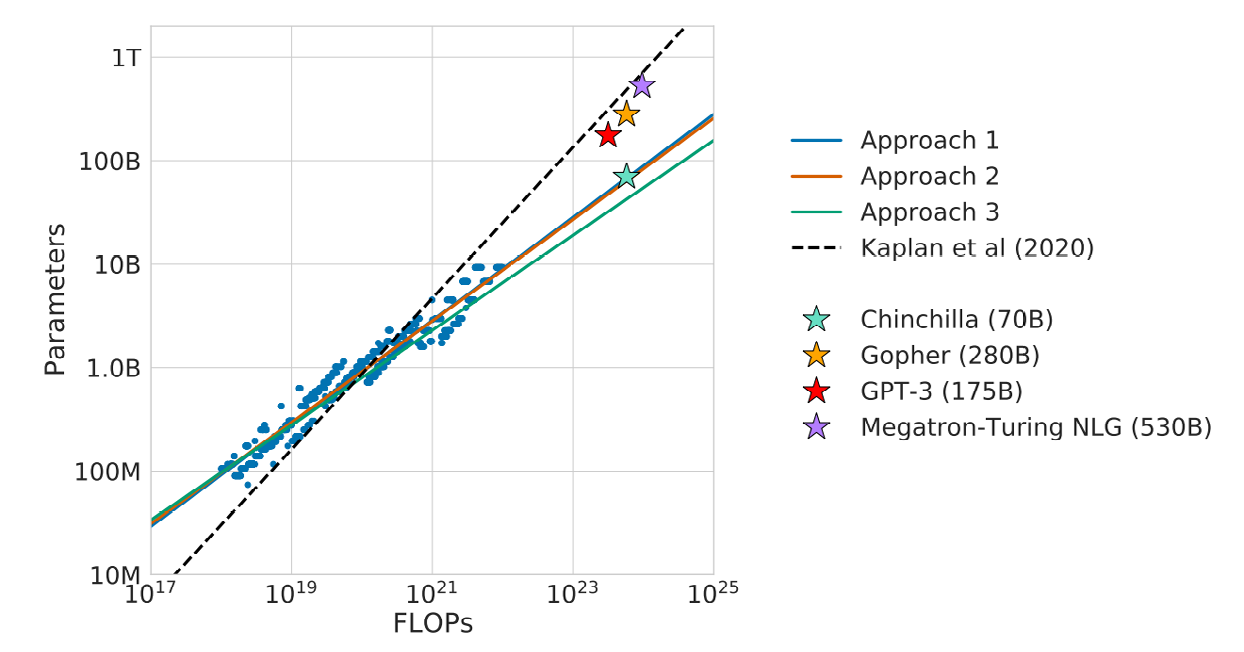

2022년까지 대형 언어 모델은 주로 모델 크기를 키우는 방식으로 확정되어 왔다. 이때 사용된 데이터셋은 지금 기준으로 보면 상대적으로 작았으며, 가장 큰 모델조차도 약 3,000억 토큰 정도의 데이터를 사용했다.

기존 확장 방식의 기준: Kaplan et al. 연구

- Kaplan et al. (2020) 연구는 모델의 성능(크로스 엔트로피 손실 기준)이 계산 자원, 모델 크기, 데이터 크기와 어떻게 연관되는지를 분석했다.

- 그들은 다음과 같이 제안했다.

- 계산 자원(C)를 100배 늘리면:

- 모델 크기는 약 28.8배 늘려야 함 →

N_opt ∝ C^0.73 - 데이터 크기는 3.5배만 늘리면 됨 →

D_opt ∝ C^0.27

즉, 모델 크기를 우선적으로 키우는 전략이 기존에는 권장되었다.

Chinchilla 논문의 혁신: 확장 법칙 재검토

- DeepMind의 Chinchilla 논문(2022)에서는 이 확장 법칙을 다시 검토했다.

- 세 가지 방법을 통해 분석한 결과, 계산 자원이 늘어날수록 모델 크기와 데이터 크기를 거의 비슷하게 늘리는 것이 최적이라는 결론을 내렸다.

- 즉, 계산 자원을 100배 늘리면, 모델 크기 10배 증가, 데이터 크기 10배 증가 → 균형 있게 확장하는 것이 좋다는 결론이다.

Chinchilla 모델 자체

- DeepMind는 기존의 Gopher(280B 파라미터)와 동일한 계산 자원을 사용하여 70B 파라미터 모델인 Chinchilla를 훈련했다.

- 결과적으로 Chinchilla는 Goper(280B), GPT-3(175B), Megatron-Turing NLG(530B)를 다양한 다운스트림 작업에서 일관되게 능가했다.

- Gopher보다 모델 크기가 4배 작기 때문에, 메모리 사용량과 추론 비용도 더 적다.

LLM 개발의 흐름 변화 Chinchilla의 발견 이후, LLM 개발 전략은 다음과 같이 변화하기 시작했다.

- 단순히 모델만 키우는 것이 아니라 데이터 크기 또한 품질을 유지하며 함께 확장하는 것이 중요했다.

- 하지만 이 추세를 계속 따라가면, 사용 가능한 텍스트 데이터 자체가 부족해질 가능성이 생긴다.

- 이에 따라 Muenninghoff et al.은 데이터가 제한된 상황에서의 확장 법칙을 연구하기 시작했다.

PaLM(Pathways Language Model)

PaLM은 Google AI가 개발한 5400억 개 파라미터의 대형 트랜스포머 기반 언어 모델이다. 텍스트와 코드로 이루어진 대규모 데이터셋으로 훈련되었으며, 다양한 작업을 수행할 수 있다.

- 상식 추론

- 산술 추론

- 농담 설명

- 코드 생성

- 번역 등

뛰어난 성능

- PaLM은 출시 당시, GLUE, SuperGLUE와 같은 다양한 언어 벤치마크에서 최신 최고 성능(state-of-the-art)을 달성했다.

효율적인 확장 - Pathways 시스템

- PaLM의 중요한 특징 중 하나는 효율적인 확장성이다.

- Google이 개발한 Pathways 시스템 덕분에 가능한데, 이 시스템은 2개의 TPU v4 Pods에 훈련 작업을 분산시켜 대형 모델을 빠르고 안정적으로 훈련할 수 있도록 했다.

PaLM 2 (2023년 5월 공개)

PaLM 2는 PaLM의 후속 모델로, 2023년 5월에 공개되었다.

주요 특징

- 모델 구조와 훈련 방식이 향상됨

- 총 파라미터 수는 더 적음

- 성능은 향상됨

뛰어난 작업 처리 능력 PaLM 2는 다음과 같은 고급 추론 작업에서 탁월한 성능을 보인다.

- 코드 생성

- 수학 문제 해결

- 분류

- 질문-응답

- 번역

산업적 활용

- PaLM 2는 PaLM보다 더 효율적이며, Google이 Google Cloud Generative AI 제품군에 포함한 여러 상업용 모델의 기반이 되었다.

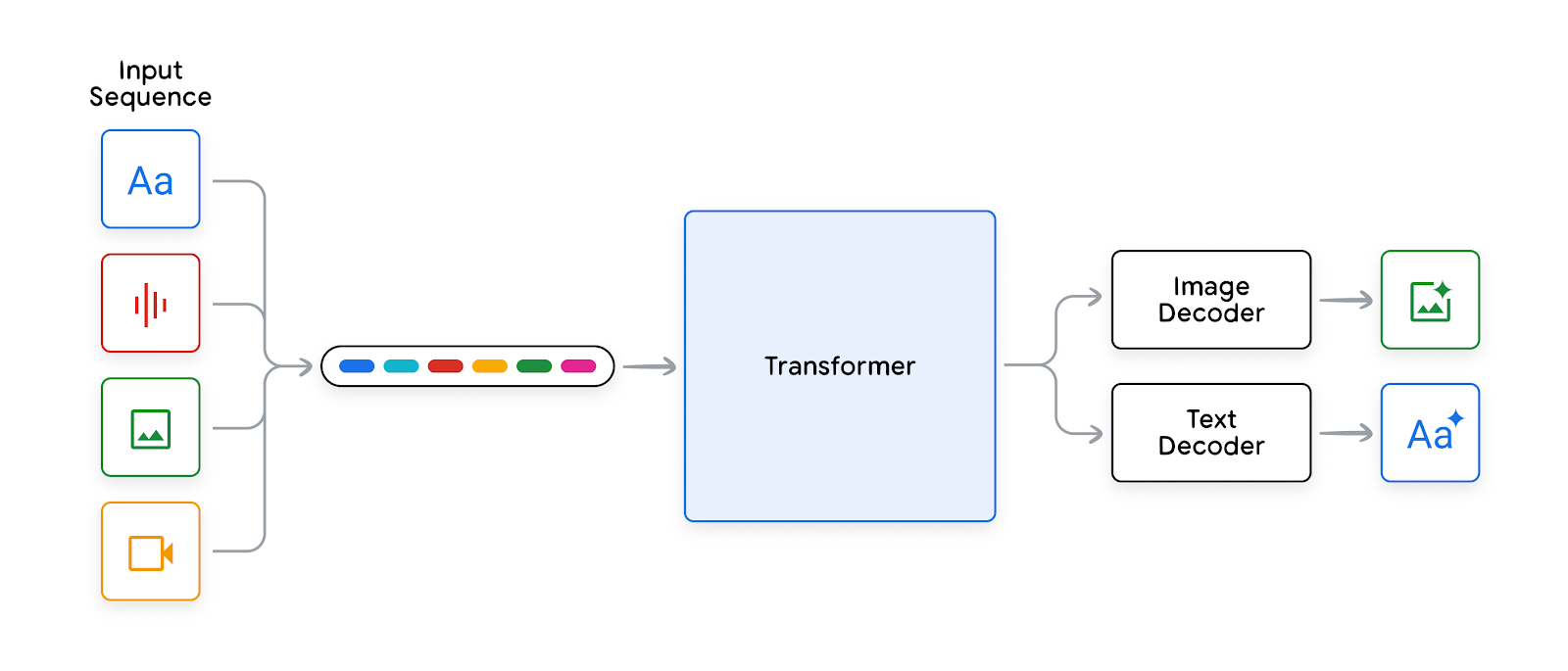

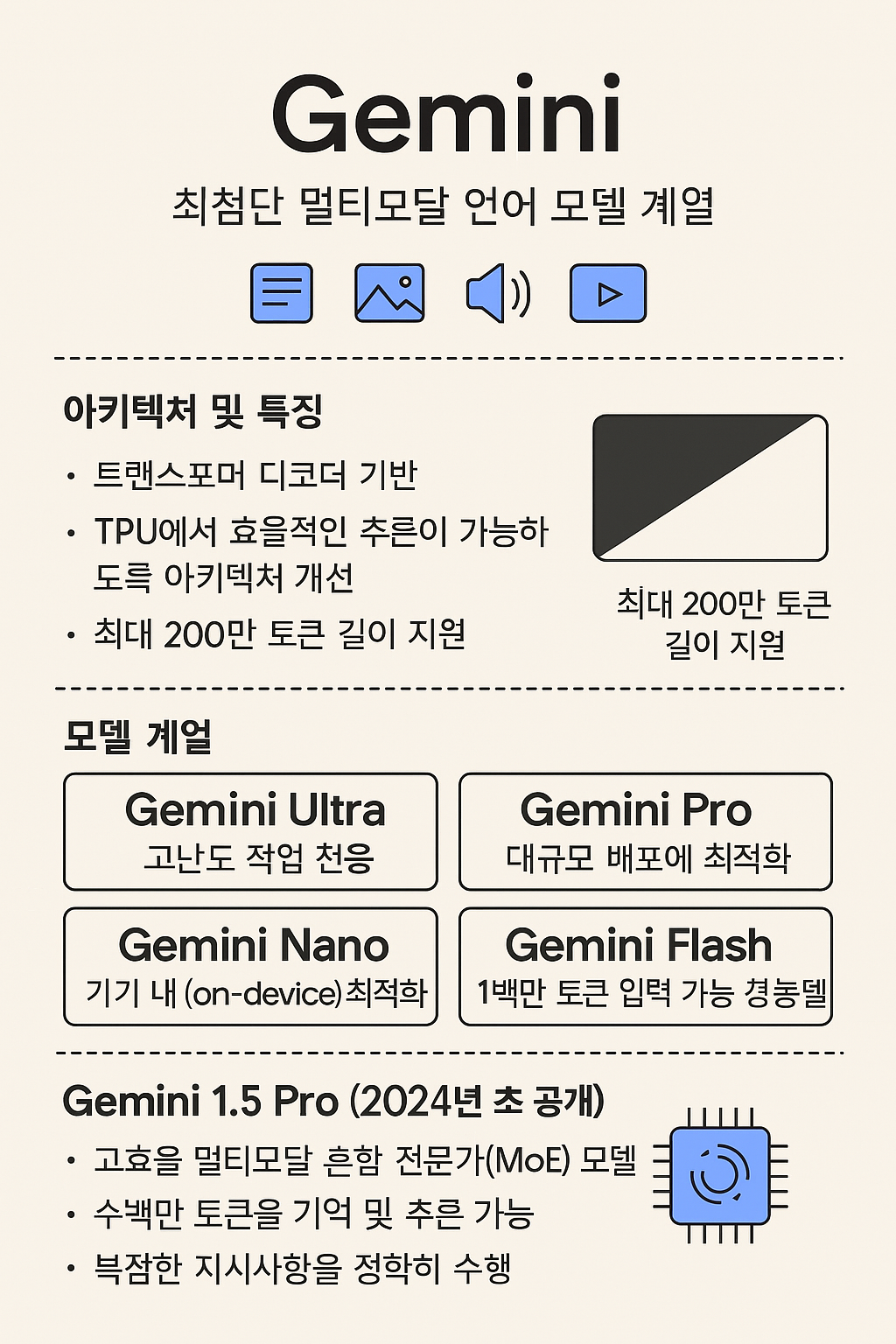

Gemini

아키텍처 및 특징

- 트랜스포머 디코더 기반으로 구축되었으며, Google의 TPU에서 효율적인 추론이 가능하도록 아키텍처가 개선되었다.

- 현재 버전에서는 최대 200만 토큰까지 입력을 지원한다.

- Multi-Query Attention 및 Mixture of Experts(MoE) 구조를 활용해 효율성과 성능을 극대화했다.

학습 환경

- TPUv5e 및 TPUv4에서 학습되었고 학습 데이터는 웹 문서, 책, 코드, 이미지, 오디오, 비디오 등으로 구성되었다.

Chinchilla 방식에 따라, 큰 모델은 계산량에 최적화된 토큰 수로 학습되고, 작은 모델은 성능 향상을 위해 더 많은 토큰으로 학습된다.

모델 개열

- Gemini Ultra

- 고난도 작업 전용

- 32개 벤치마크 중 30개에서 최고 성능(state-of-the-art) 달성

- Gemini Pro

- 대규모 배포에 최적화된 버전

- Gemini Nano

- 기기 내(on-device) 실행용으로 설계

- 경량 모델이지만 요약, 독해 등에서 매우 뛰어난 성능

- Gemini Flash

- 가장 빠른 모델

- 1백만 토큰 입력을 지원하며, 고빈도 작업에 적합

- 경량형이지만 강력한 멀티모달 추론 능력 보유

Gemini 1.5 Pro (2024년 초 공개)

- 고효율 멀티모달 MoE 모델

- 수백만 토큰을 기억하고, 그 위에서 추론할 수 있음

- 긴 문서들, 오디오/비디오 등도 포함

주요 능력

- 코드 이해 : 방대한 코드베이스 분석 및 고급 질문 응답

- 언어 학습 : 학습 시 본 적 없는 언어도, 참고 자료만으로 학습 가능

- 멀티모달 추론 : 그림을 보고 소설 속 장면을 찾아낼 수 있음

- 비디오 이해 : 영화 전체를 분석하고 시간대별로 정확하게 응답 가능

성능

- 최대 530,000 토큰 : 100% 정보 검색 성공

- 100만 토큰 : 99.7% 정보 검색 성공

- 1천만 토큰 : 99.2% 정확도 유지

복잡한 지시 수행

- 406개의 다단계 지시 테스트에서 이전 모델들보다 월등히 뛰어난 성과

- 90% 지시 정확히 수행, 66%는 완전히 완료

Gemini 2.0(2024년 말 공개)

🔹 Gemini 2.0 Flash

- 속도와 효율성에 초점

- 1.5 Pro보다 더 빠르면서도 높은 품질 유지

- 텍스트 처리, 코드 생성, 비디오 분석, 공간 추론(Spatial Reasoning) 등 향상

- 특히 작은 객체 인식 및 캡션 생성 능력 강화

🔹 Gemini 2.0 Pro

- 다양한 작업에 고성능 적용 가능한 범용 모델

- 원래의 Gemini Pro보다 다양한 도메인에서 향상된 성능 제공

🔹 Gemini 2.0 Nano

- 모바일 등 기기 내(on-device) 실행 최적화

- 속도와 자원 효율성이 강점

🔹 Gemini 2.0 Flash Thinking Experimental

- 고성능 추론 전용 실험 모델

- “생각 과정을 시각적으로 보여주는” 해설 기능 포함

- 수학, 과학 등 복잡한 문제 해결에 강력한 성능

- 입력: 텍스트 + 이미지

- 출력: 텍스트

- 지원: 최대 100만 토큰 입력, 64,000 토큰 출력

- 코드 실행 가능, 지식 커트오프: 2024년 8월

- 지연(latency)보다 정확성이 중요한 작업에 적합

- Google AI Studio, Gemini API, Vertex AI에서 제공 (실험적 제공 중)

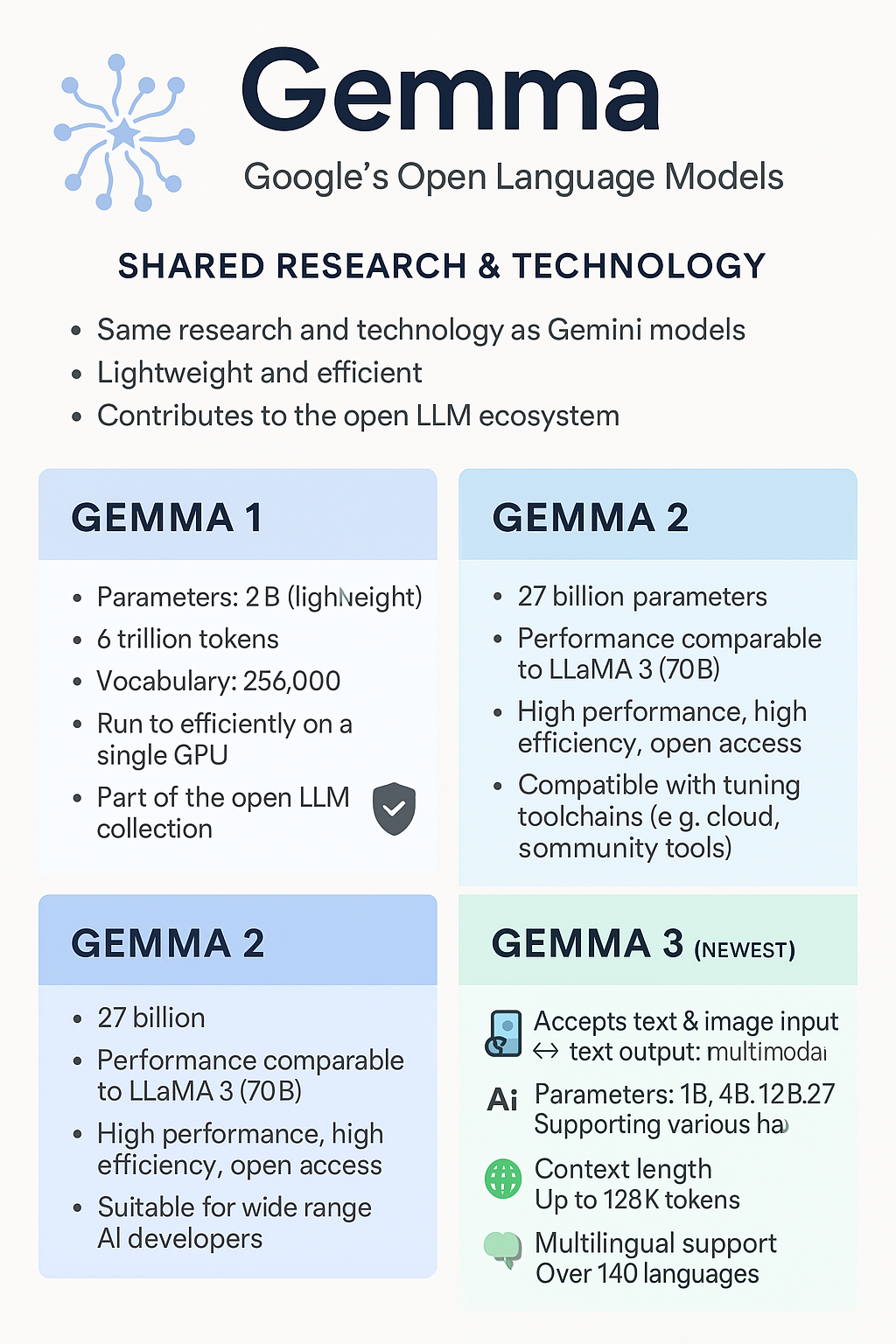

🌟 Google의 오픈 언어 모델 시리즈 – Gemma

🧬 공통 기반

- Gemini 모델과 동일한 연구 및 기술 기반

- 가볍고 효율적인 모델 구성

- 오픈소스 LLM 생태계에 기여

🪶 Gemma 1

| 항목 | 내용 |

|---|---|

| 🧠 파라미터 수 | 2B (경량형) |

| 📚 학습 데이터 | 6조 토큰 |

| 🔡 어휘 크기 | 256,000 단어 |

| ⚡ 특징 | 단일 GPU에서도 고효율 실행 가능 |

| 🌍 공개 여부 | ✅ 오픈소스 (공개 LLM 컬렉션에 포함) |

🚀 Gemma 2

| 항목 | 내용 |

|---|---|

| 🧠 파라미터 수 | 27B |

| 📊 성능 | **LLaMA 3 (70B)**에 필적하는 성능 |

| 🎯 목적 | 고성능 + 고효율 + 오픈 액세스 |

| 🔧 호환성 | 다양한 튜닝 툴체인과 호환 (클라우드, 커뮤니티 도구 등) |

| 🧩 적용 범위 | 폭넓은 AI 개발자 사용에 적합 |

🧠 Gemma 3 (최신)

| 항목 | 내용 |

|---|---|

| 🔄 입력 유형 | 텍스트 + 이미지 입력, 텍스트 출력 (멀티모달) |

| 🧠 파라미터 종류 | 1B / 4B / 12B / 27B → 다양한 하드웨어 환경 지원 |

| 📏 컨텍스트 길이 | 최대 128K 토큰 |

| 🌐 언어 지원 | 140개 이상 언어 |

| 🧭 활용 용도 | 경량 기기부터 고성능 서버까지 다양한 환경 대응 가능 |

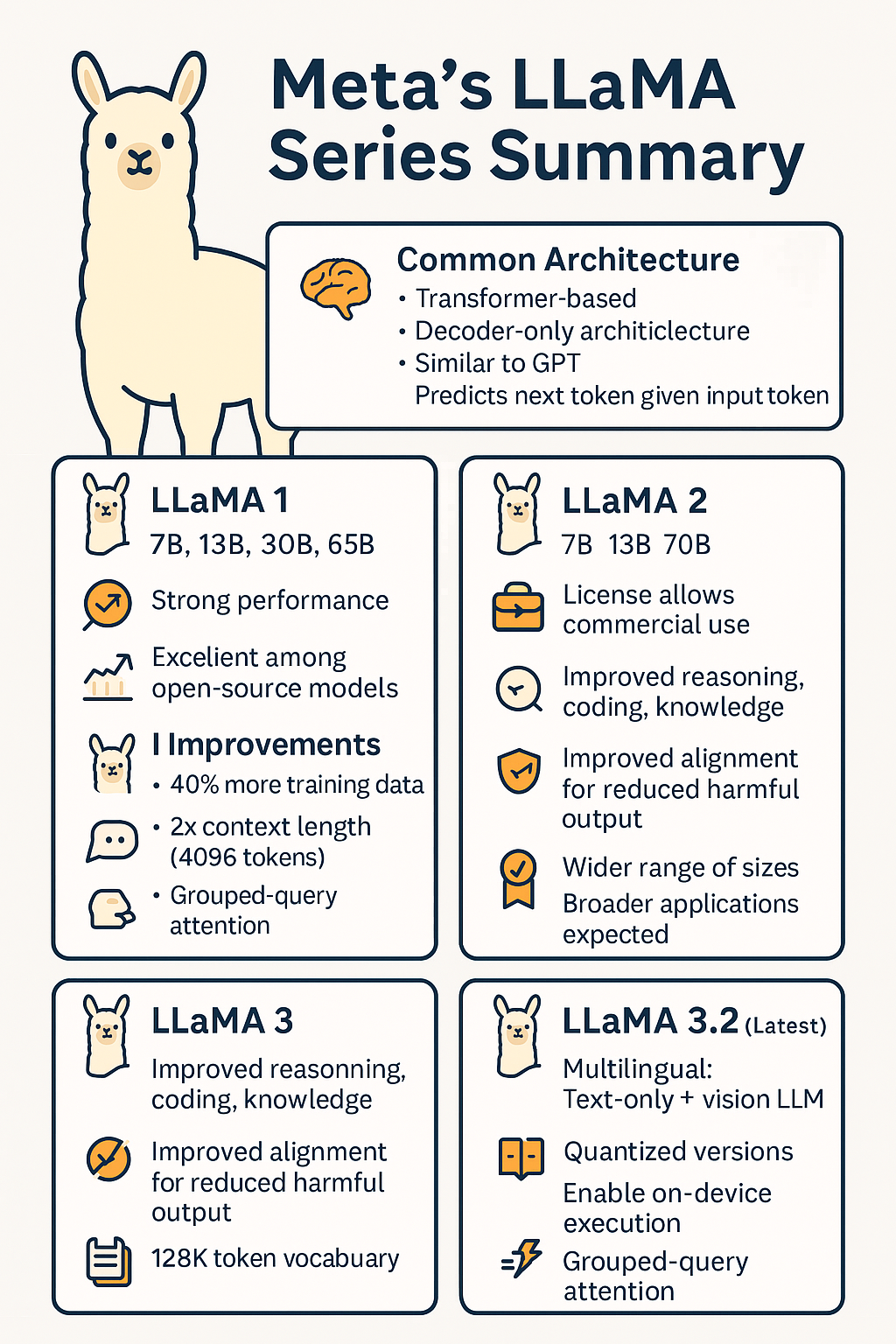

🦙 Meta의 LLaMA 시리즈 요약

🧠 공통 구조

- 트랜스포머 기반

- 디코더 전용(Decoder-only) 아키텍처

- GPT 계열과 유사

- 입력된 토큰을 바탕으로 다음 토큰 예측

🦙 LLaMA 1

| 항목 | 내용 |

|---|---|

| 📏 크기 | 7B, 13B, 30B, 65B |

| 🔍 특징 | - 강력한 성능 - 오픈소스 모델 중 우수한 퍼포먼스 |

🦙 LLaMA 2

| 항목 | 내용 |

|---|---|

| 📏 크기 | 7B, 13B, 70B |

| 💼 라이선스 | 상업적 사용 허용 |

| 📈 향상 내용 | - 학습 데이터 40% 증가 - 문맥 길이 2배 (4096 tokens) - Grouped-Query Attention 도입 |

| 🗨️ 대화 특화 | LLaMA 2-Chat: 채팅에 최적화된 튜닝 모델 |

🦙 LLaMA 3

| 항목 | 내용 |

|---|---|

| 🧠 목표 | 추론, 코딩, 지식 분야 성능 향상 |

| 🔒 안전성 | 유해 출력 감소 위한 학습 및 정렬 강화 |

| 📈 기대 사항 | - 더 넓은 크기 범위 - 다양한 활용 영역 대응 |

🦙 LLaMA 3.2 (최신)

| 항목 | 내용 |

|---|---|

| 🌐 다국어 지원 | 텍스트 전용 + 멀티모달(비전 LLM 포함) |

| ⚙️ 경량화 | 양자화 버전 제공 → 기기 내 실행 가능 |

| 🔡 어휘 | 128K 토큰 어휘 집합 |

| ⚡ 기술 | Grouped-Query Attention 유지 |

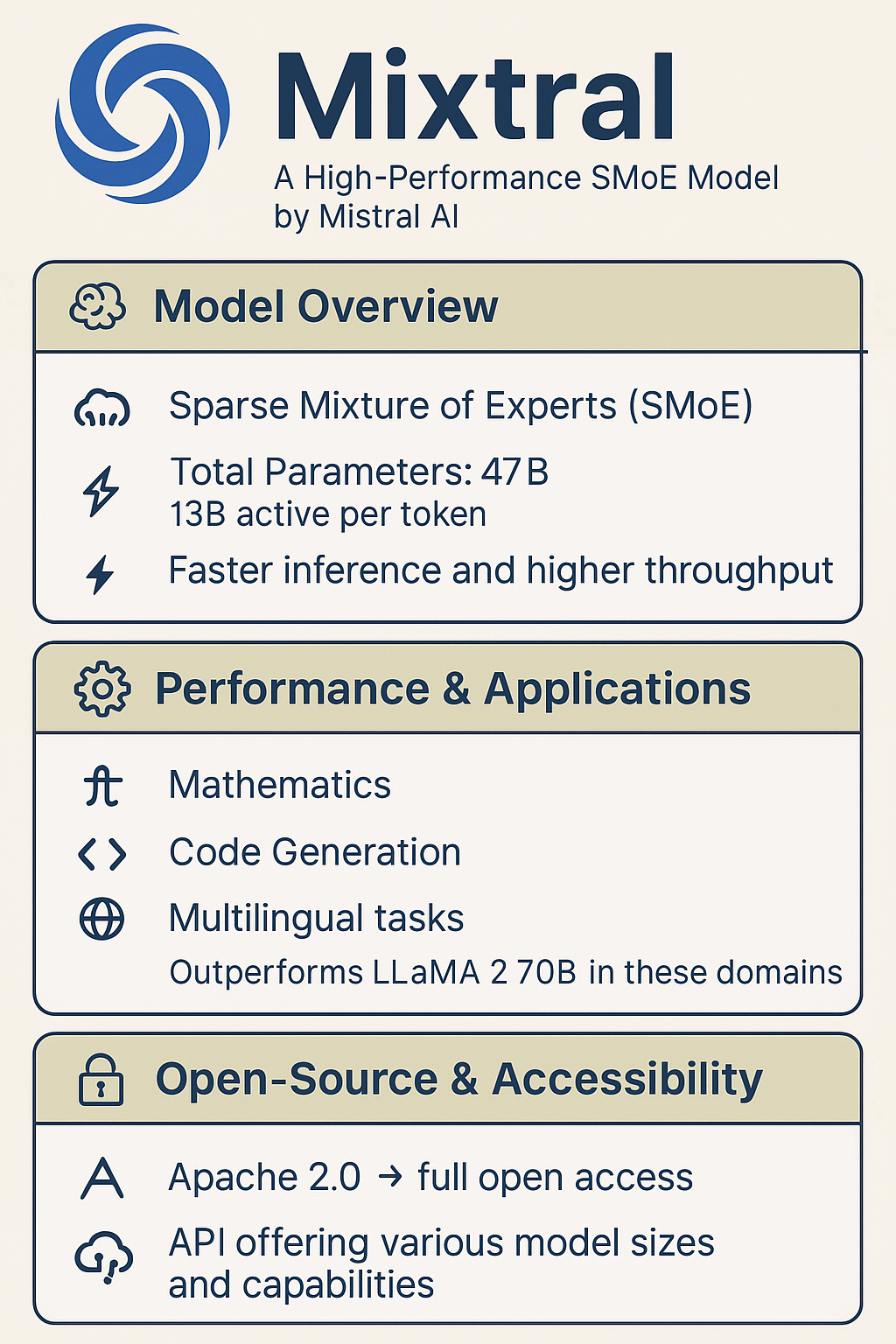

🌀 Mixtral – Mistral AI의 고성능 SMoE 모델

🧱 모델 개요

| 항목 | 내용 |

|---|---|

| 🧠 모델명 | Mixtral 8x7B |

| 🧬 구조 | Sparse Mixture of Experts (SMoE) |

| 🔢 총 파라미터 수 | 47B (전체), 13B만 활성화됨 (토큰당) |

| ⚡ 추론 효율성 | 더 빠른 추론과 높은 처리량 제공 |

🧠 성능 및 활용 영역

-

수학 문제 해결

-

코드 생성

-

다국어 처리(Multilingual)

-

위 분야에서 LLaMA 2 70B보다 뛰어난 성능 보임

📏 문맥 길이 지원: 최대 32,000 토큰

📚 튜닝 모델 – Mixtral 8x7B-Instruct

-

지시어 기반(Instruct tuning) 모델

-

사람 평가 기준으로 여러 폐쇄형 모델보다 우수한 결과 달성

🔓 오픈소스 및 접근성

| 항목 | 내용 |

|---|---|

| 📜 라이선스 | Apache 2.0 → 완전한 오픈 액세스 |

| ☁️ API 제공 | 다양한 모델 크기 및 기능을 제공하여 사용자의 요구에 맞춘 API 활용 가능 |

🧠 OpenAI O1

OpenAI의 새로운 “O1” 시리즈는 모델 성능의 획기적인 도약을 보여주는 모델군으로,

복잡한 추론 능력에 초점을 맞추고 있으며,

**강화학습(재강화 학습, Reinforcement Learning)**을 통해 이러한 능력을 정교하게 다듬었습니다.

🔗 체인 오브 쏘트(Chain-of-Thought) 내부 처리

-

O1 모델은 내부적으로 **“생각의 흐름(Chain of Thought)”**을 적용해,

응답을 생성하기 전 깊이 있는 사고(deliberation) 과정을 거칩니다. -

이러한 신중한 추론 기반 접근 방식 덕분에

복잡한 과학적 추론 문제에서도 탁월한 성능을 발휘합니다.

📈 벤치마크 성능

O1 모델은 다음과 같은 고난이도 벤치마크에서 우수한 성과를 보였습니다:

-

Codeforces 프로그래밍 대회: 상위 89 퍼센타일

-

AIME(미국 수학 올림피아드 예선): 전국 상위 500위권

-

GPQA (물리학, 생물학, 화학 포함 고난이도 과학 문제집):

→ 박사급 인간 정확도(PhD-level human accuracy) 능가

⚙️ API 제공 모델

-

o1 (주력 모델)

- 광범위한 일반 지식이 필요한 난이도 높은 문제 해결에 최적화

-

o1-mini (경량 고속 모델)

-

더 빠르고 비용 효율적

-

코딩, 수학, 과학처럼 특화된 깊은 지식이 중요한 영역에서 뛰어남

-

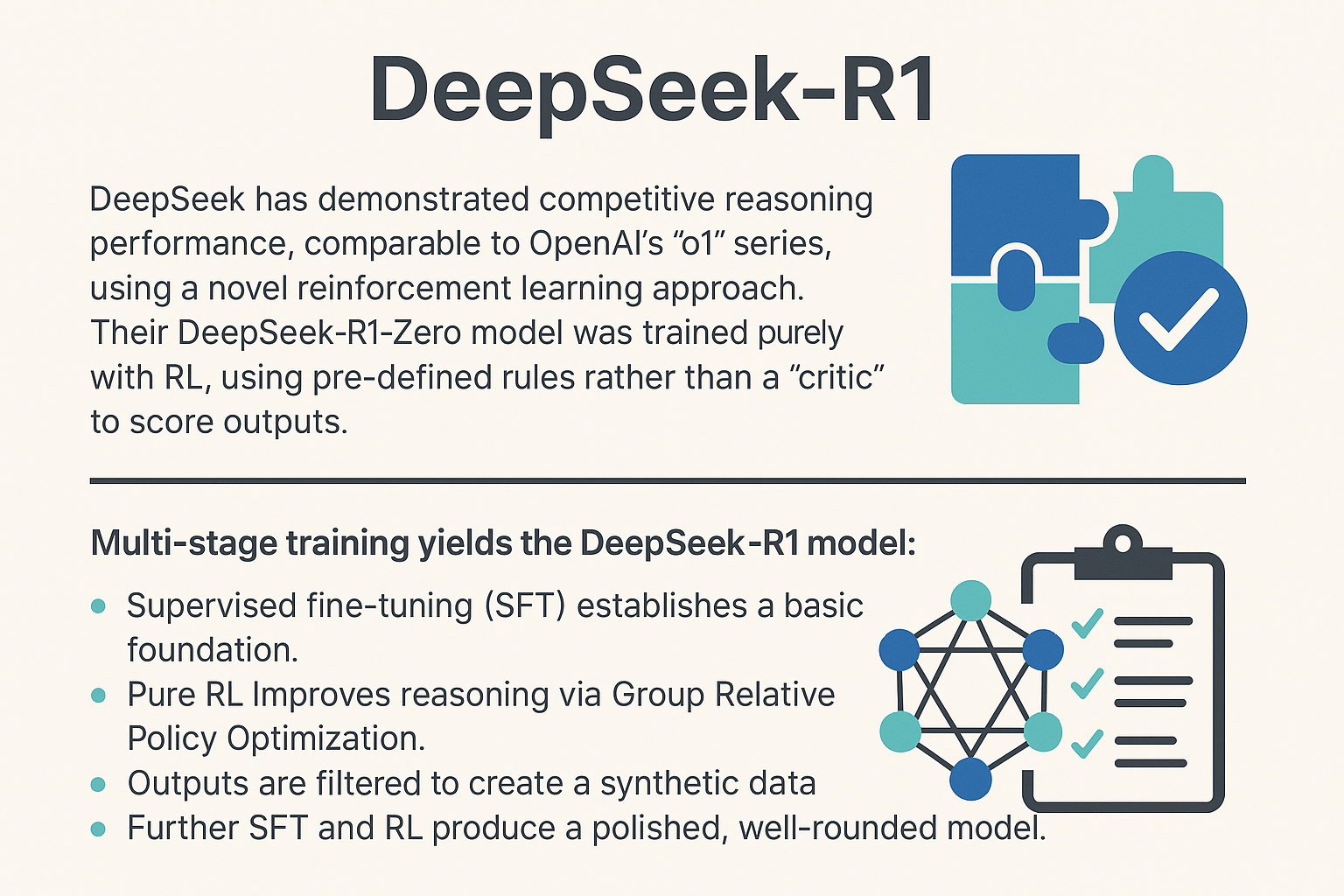

🧠 DeepSeek

DeepSeek는 OpenAI의 O1 시리즈에 필적하는 고급 추론 능력을

광범위한 라벨링 데이터 없이, 새로운 강화 학습 기법을 통해 달성할 수 있음을 보여주었습니다.

대표적인 예가 DeepSeek-R1-Zero 모델입니다.

이 모델은 **오직 강화학습(RL)**만으로 훈련되었습니다.

🔍 기존 RL 방식 vs DeepSeek 방식

❌ 기존 방식:

- 대부분의 LLM용 강화학습은 “비평자(Critic)” 모델을 필요로 함

→ 이는 사람이 라벨링한 데이터로 학습되어, 모델 출력에 피드백 제공

✅ DeepSeek의 혁신: GRPO (Group Relative Policy Optimization)

-

비평자 없이 작동

-

미리 정의된 규칙(예: 일관성, 완성도, 유창성)을 기준으로

여러 출력 결과에 점수를 매김 -

모델은 자신의 출력이 집단 평균보다 좋은지 비교하며 학습함

→ 일종의 자기 대결(Self-play) 방식

📉 초기 문제점

-

DeepSeek-R1-Zero는 **고난도 수학 추론(AIME 2024)**에서 O1과 동급 성과를 보였지만,

초반에는 다음과 같은 문제가 있었습니다:-

문장 가독성 부족

-

언어 혼용 현상 발생

-

🛠️ DeepSeek-R1의 다단계 훈련 프로세스

-

1단계: SFT (Supervised Fine-Tuning)

- 소규모 “콜드 스타트” 데이터셋으로 기본 언어 이해력 형성

-

2단계: 순수 강화학습 (Pure-RL)

-

GRPO 적용 → 추론 능력 향상

-

DeepSeek-R1-Zero 방식과 유사

-

-

3단계: 거절 샘플링 (Rejection Sampling)

-

모델이 여러 개의 출력 생성 → GRPO 기준으로 가장 좋은 것만 선택

-

이를 통해 고품질 “합성 데이터셋” 생성

-

-

4단계: 최종 SFT + RL

-

기존 감독학습 데이터 + 합성 데이터 결합

-

마지막으로 전체 성능을 다듬고 일반화 능력 강화

-

🌟 결과: DeepSeek-R1

-

O1 모델을 능가하거나 동급 성능 달성

-

복잡한 문제에서의 Chain-of-Thought 추론은

→ 이 훈련 방식과 본질적으로 연결

⚠️ 오픈소스? 반쯤만

-

DeepSeek는 모델 가중치를 제공하지만

-

훈련 데이터,

-

처리 스크립트,

-

데이터 정제 과정에 대한 투명성이 없어

→ 사실상 폐쇄형 모델

-

🌍 기타 오픈 언어 모델(Open LLMs)

오픈소스 LLM 생태계는 매우 빠르게 발전 중이며,

코드와 사전학습된 가중치가 모두 공개된 모델도 점점 많아지고 있습니다.

아래는 대표적인 예시들입니다:

🔸 Qwen 1.5 (by Alibaba)

| 항목 | 내용 |

|---|---|

| 🧠 모델 크기 | 0.5B, 1.8B, 4B, 7B, 14B, 72B |

| 📏 문맥 길이 | 최대 32,000 토큰 지원 |

| 📈 성능 | - 다양한 벤치마크에서 강력한 성능 |

-

특히 Qwen 1.5-72B는 LLaMA 2-70B를 전 벤치마크에서 능가

-

언어 이해, 추론, 수학 분야에서 뛰어남

🔸 Yi (by 01.AI)

| 항목 | 내용 |

|---|---|

| 🧠 모델 크기 | 6B, 34B |

| 📚 학습 데이터 | 영어 + 중국어 포함 총 3.1조 토큰 |

| 📏 문맥 길이 | 200K 토큰 버전도 있음 |

| 📸 확장 모델 | Yi-VL (비전-언어 모델) |

| ⚙️ 효율성 | - 4비트 양자화로 일반 GPU에서도 실행 가능 |

| 🎯 성능 | 34B 모델은 GPT-3.5에 필적하는 성능 |

| ✅ 데이터 품질 | 철저한 정제 및 필터링으로 데이터 품질 강조 |

🔸 Grok 3 (by xAI, 일론 머스크 주도)

| 항목 | 내용 |

|---|---|

| 🧠 모델 종류 | Grok 3 (Think), Grok 3 mini (Think) |

| 🧠 학습 방식 | 강화학습 기반(RL) |

| 🤔 특징 | - 오답 수정(backtracking) |

-

단계 단순화, 사전학습 지식 활용 등 전략 학습

| 📏 문맥 길이 | 최대 100만 토큰 -

이전 모델보다 8배 증가

Summary Model

Fine-tuning large language models

대형 언어 모델은 보통 여러 단계의 훈련을 거쳐 만들어진다. 그 중 첫 번째 단계는 사전학습(pre-training)이라고 한다.

사전학습(Pre-training)

- 정의 : 다양한 종류의 라벨 없는 텍스트 데이터를 사용해, 앞에 나온 단어들을 보고 다음에 어떤 단어가 나올지 예측하는 연습을 시키는 과정이다.

- 이 과정을 통해 모델은 언어를 이해하고 만들어내는 기본 능력을 얻게 된다.

파인튜닝(Fine-tuning, 미세조정)

- 정의 : 사전학습이 끝난 모델에게 특정한 임무를 더 잘 하도록 추가로 훈련시키는 과정이다.

- 파인튜닝은 지시를 따르게 하는 훈련 또는 감독학습 파인튜닝이라고 한다.

- 이때는 특정 작업에 대한 예시 데이터(정답 포함)을 사용한다.

파인튜닝을 통해 좋아질 수 있는 예들

- Instruction-tuning

- 예 : “이 글을 요약해줘”, “이 코드를 짜줘.”

- Dialogue-tuning

- 예 : 질문과 답변 형태로 대화하는 훈련 (여러 번 주고받는 대화 - 멀티턴 다이얼로그)

- Safety tuning(안전성 훈련)

- 모델이 편견, 차별, 공격적인 말을 하지 않도록 만드는 과정

- 사람이 직접 확인하고 피드백을 주는 방식(Human-in-the-loop)

- RLHF(사람의 피드백을 활용한 강화학습)

Supervised fine-tuning

앞에서 언급한 것처럼 SFT는 LLM의 성능을 특정 작업이나 작업 집합에 대해 향상시키기 위해, 도메인 특화되고 라벨이 있는 데이터로 모델을 추가 학습시키는 과정입니다. 이때 사용하는 데이터셋은 보통 사전학습 때 사용한 데이터셋보다 훨씬 작고, 사람이 직접 선별한 고품질의 데이터인 경우가 많다. 이런 환경에서 각 데이터 포인트는 입력(prompt)과 예시 응답(target response)으로 구성된다.

- 질문(prompt)과 답변(target response)

- 한 언어(prompt)에서 다른 언어(target response)로의 번역

- 요약할 문서(prompt)와 그에 해당하는 요약(target response)

중요한 점은 파인튜닝은 위에서 말한 특정 작업에서의 성능 향상뿐만 아니라, 모델이 더 안전하고 덜 공격적이며 더 대화형이고 지시를 잘 따르는 방향으로 행동을 개선하는 데에도 쓰일 수 있다.

인간 피드백을 이용한 강화학습(Reinforcement Learning from Human Feedback, RLHF)

보통 SFT(감독학습 파인튜닝)이 끝난 후, 두 번째 파인튜닝 단계로 RLHF이라는 과정을 진행한다. 이 기술은 LLM이 사람의 선호에 더 잘 맞는 응답을 하도록 도와주는 강력한 파인튜닝 방법이다. 예를 들어, 모델의 응답을 더 도움이 되게, 사실에 가깝게, 안전하게 만들어주는 것이다.

SFT와 RLHL의 차이점

- SFT는 모델에게 좋은 예시(질문-답변쌍)만 보여줘서 학습시키는 방식이에요

- RLHF는 여기에 안 좋은 예시도 보여주고, 모델이 원하지 않는 응답을 하면 벌점을 줘서, 안 좋은 응답을 덜 하게 훈련시킨다. → 그래서 더 안전하고 유익한 응답을 생성할 가능성이 높아진다.

보상 모델(Reward Model, RM) RLHL를 사용하려면 먼저 보상 모델을 훈련해야 한다. 이 모델은 기본적으로 사전학습된 트랜스포머 모델을 사용해서 시작하고, 사람의 선호가 담긴 데이터로 튜닝한다. 보상 모델 훈련 방식 예시

- 한 쌍의 응답(A와 B) 중에서 어떤 게 더 좋은지 사람에게 물어본다.

- 이때 사람의 선택이 바로 human feedback이다.

피드백(선호도) 형식의 예시

- 이진값 : 좋음/나쁨

- 리커드 척도 : 점수로 평가(예 : 1점 ~ 5점)

- 순위 : 응답이 2개 이상일 때 어떤 게 더 좋은지 순서대로 평가

- 상세 평가 : 문장의 질, 안전성, 도움됨, 공정성, 사실성 등 다양한 기준을 함께 고려

RLHF 전체 과정 요약

- 보상 모델(RM)을 사람의 피드백 데이터로 훈련

- 이 RM을 사용해서, 강화학습 알고리즘을 적용

- 기존에 instruction-tuning까지 끝난 LLM을 사람이 선호하는 방식으로 더 정교하게 튜닝

인간 대신 AI가 평가하는 방법: RLAIF RLHF는 사람이 직접 피드백을 줘야 해서 비용이 많이 든다.그래서 최근에는 AI가 사람 대신 피드백을 주는 방식도 쓴다. 이를 RLAIF(Reinforcement Learning from AI Feedback)이라고 한다. 또한 최근에는 보상 모델이나 강화학습 없이도 RLHF를 대체하는 방법도 연구되고 있다. 예 : DPO(Direct Preference Optimization)

[1단계] 사전학습된 모델 (Pretrained LLM)

|

v

[2단계] 지시 따르기 훈련 (Instruction Tuning, SFT)

- 예시: 질문 → 정답 알려주며 학습

|

v

[3단계] 보상 모델 훈련 (Reward Model Training)

- 사람들에게 2개의 응답 보여주고, 더 나은 응답 선택하게 함

- 예시:

질문: "오늘 날씨 어때?"

응답 A: "좋아요."

응답 B: "서울은 맑고 22도예요."

→ 사람은 B를 선택!

|

v

[4단계] 보상 모델 완성 (RM)

- 이제 RM은 어떤 응답이 좋은지 점수를 줄 수 있음

|

v

[5단계] 강화 학습 시작 (RL)

- 기존 LLM이 여러 응답을 생성함

- RM이 응답을 평가하여 점수를 줌 (보상/벌점)

- 점수를 바탕으로 모델이 스스로 더 나은 답을 생성하도록 학습

|

v

[6단계] RLHF 완료된 LLM 🎉

- 이제 사람의 선호에 더 잘 맞는 답변을 생성함

- 더 안전하고, 도움되고, 사실적인 응답 가능!

PEFT(Parameter Efficient Fine-Tuning)

앞서 배운 SFT(감독학습 파인튜닝)나 RLHF(인간 피드백을 이용한 강화학습)는 성능이 좋긴 하지만, 엄청나게 많은 계산 자원(GPU, 시간 등)이 필요하다. 왜냐하면 모델 전체를 다시 훈련시켜야 하기 때문이다. 이 문제를 훨씬 싸고 빠르게 해결할 수 있는 방법이 PEFT이다.

PEFT란?

PEFT는 모델 전체를 훈련하는 대신, 아주 작은 일부만 살짝 바꾸는 방식이다. PEFT는 작동 방식

- 이미 잘 학습된 모델을 가져온다.

- 그 모델에 작은 새로운 덧붙임을 추가한다.

- 이 덧붙임만 학습시켜서 모델을 새로운 작업에 맞게 조정한다.

대표적인 PEFT 방법들

- 어댑터 기반 파인튜닝(Adapter-based Fine-Tuning)

- 기존 모델에 작은 모듈을 붙이다.

- 전체 모델을 바꾸지 않고, 이 어댑터 부분만 학습한다.

- 로우랭크 어댑테이션(LoRA : Low-Rank Adaptation)

- 기존 모델의 큰 행렬을 직접 바꾸지 않고, 대신에 작은 2 개의 행렬로 업데이트를 흉내낸다.

- 원래 모델을 그대로 두고, LoRA 부분만 학습한다.

- 최신 기술인 QLoRA는 이 행렬을 압축해서 더 효율적이다.

- LoRA 장점

- 플러그처럼 작업별로 교체 가능

- 모델 전체를 주고 받을 필요 없이, LoRA 부분만 공유해도 된다.

- 소프트 프롬프트(Soft Prompting)

- 보통 모델에 “질문처럼” 텍스트로 프롬프트를 주지만, 이 방식은 그런 프롬프트 대신 학습 가능한 벡터를 넣는다.

- 이 벡터는 5개 토큰 정도로 아주 작고 가볍게 학습 가능하다.

- 다양한 작업을 혼합해서 처리할 수 있는 장점도 있다.

정리 비교표

| 방법 | 성능 | 비용/자원 | 특징 |

|---|---|---|---|

| 전체 파인튜닝 | 🔥 최고 | ❌ 매우 높음 | 전체 모델 수정 |

| LoRA | 👍 좋음 | ✅ 매우 효율적 | 교체 가능, QLoRA로 더 빠름 |

| Soft Prompting | 😊 괜찮음 | ✅ 아주 효율적 | 간단하고 빠름 |

Using large language models

프롬프트 엔지니어링(prompt engineering)과 샘플링 기법(sampling techniques)은 LLM의 성능에 큰 영향을 미친다. 프롬프트 엔지니어링이란, 원하는 결과와 관련성 있는 출력을 얻기 위해 LLM에 입력하는 텍스트(프롬프트)를 설계하고 다듬는 과정을 말한다. 샘플링 기법은 출력 토큰을 어떤 방식으로 선택할지를 결정하는 방법으로 결과의 정확성, 창의성, 다양성에 영향을 준다.

Prompt engineering

대형 언어 모델(LLM)은 매우 강력하지만, 그 잠재력을 완전히 발휘하려면 적절한 안내가 필요하다. 프롬프트 엔지니어링은 LLM이 원하는 출력을 생성하도록 올바른 방향으로 유도하는 중요한 과정이다. 이 작업은 모델이 사실에 기반한 응답을 하도록 유도하거나, 창의력을 발휘하여 이야기나 노래를 쓰도록 유도하는 것 등을 포함할 수 있다. 프롬프트 엔지니어링 예시로는 다음과 같은 것들이 있다.

- LLM에게 명확한 지시를 제공하기

- 예시를 제공하기

- 핵심 키워드 사용하기

- 중요한 정보를 강조할 수 있도록 포맷팅

- 배경 정보를 추가로 제공하기

Few-shot prompting

- LLM에게 작업 설명과 함께, 3~5개 정도의 잘 선택된 예시를 함께 제공하는 방식이다.

- 전달한 예시들이 LLM의 응답 방향을 잘 잡아주도록 도와준다.

Zero-shot prompting

- 예시 없이 LLM에게 직접 지시만 주는 방식이다.

- LLM은 자신이 이미 학습한 지식을 바탕으로 정답을 예측한다.

- 예시가 없기 때문에 Zero-shot이라고 부른다.

- 다만, 퓨샷보다 신뢰도가 낮을 수 있다.

Chain-of-thought prompting

- 복잡한 추론이 필요한 작업에서 성능을 향상시키기 위한 방식이다.

- 단순히 질문을 던지지 않고, 유사한 문제를 단계별로 해결하는 방식을 먼저 보여준다.

- 그러면 LLM도 스스로 생각의 흐름(추론 과정)을 만들고 문제를 작은 단계로 나눠서 해결한 다음, 최종 정답을 도출한다.

Sampling Techniques and Parameters

댜양한 샘플링 기법이 모델이 시퀀스에서 다음 토큰을 선택하는 방식을 결정하는 데 사용될 수 있다. 이들은 LLM의 출력에 대한 품질, 창의성, 다양성을 제어하는 데 필수적이다. 다음은 다양한 샘플링 기법과 그에 따른 중요한 파라미터들의 설명이다.

- 그리디 서치(Greedy search) : 각 단계에서 가장 확률이 높은 토큰을 선택한다. 가장 단순한 옵션이지만, 반복적이고 예측 가능한 출력을 생성할 수 있다.

- 랜덤 샘플링(Random sampling) : 예측된 확률 분포에 따라 다음 토큰을 선택한다. 각 토큰은 해당 확률에 비례하여 샘플링 된다. 더 놀랍고 창의적인 텍스트를 생성할 수 있지만, 말이 안 되는 출력이 나올 가능성도 커진다.

- 온도 샘플링(Temperature sampling) : 확률 분포를 온도 파라미터로 조정한다. 온도가 높을수록 다양성이 증가하고, 온도가 낮을수록 확률이 높은 토큰을 더 선호하게 된다.

- Top-K sampling : 가장 확률이 높은 K개의 토큰 중에서 랜덤하게 선택한다. K 값은 랜덤성의 정도를 제어한다.

- Top-P sampling : 누적 확률이 P가 될 때까지의 동적인 토큰 집합에서 샘플링한다. 이 방법은 모델이 자신감이 없을 때는 더 많은 후보에서 다양성을 확보하고, 자신감이 있을 때는 확률이 높은 소수의 단어에 집중할 수 있도록 한다.

- Best-of-N sampling : 서로 다른 N개의 응답을 생성하고, 사전에 정해진 기준(예: 보상모델 또는 논리 일광성 검사)에 따라 가장 좋은 응답을 선택한다. 이 방식은 짧은 문장이나 논리와 추론이 중요한 상황에서 특히 유용하다.

Task-based Evaluation

LLM의 등장은 AI 애플리케이션 개발의 장벽을 낮췄지만, 최소 기능 제품(MVP)에서 실제 운영 환경(Production)으로 전환하는 과정에서는 프롬프트 엔지니어링, 모델 선택, 성능 모니터링과 같은 여러 도전 과제가 발생한다. 이러한 상황을 잘 해쳐 나가려면, 기능성과 사용자 경험을 검증하고, 잠재적인 문제를 식별하며, 모델의 기능에 대한 소통을 돕고, 개선 로드맵을 수립할 수 있는 맞춤형 평가 프레임워크가 필수적이다. 맞춤형 평가 프레임워크를 구축하기 위해, 애플리케이션 개발자는 자체 평가 데이터, 개발 맥락, “좋은 성능”에 대한 정의를 제공해야 한다.

-

평가 데이터 : LLM의 기능을 보여주는 공개 리더보드는, 보다 맞춤화된 평가 방식이 필요한 애플리케이션 개발자에게는 부족할 수 있다. 실제 운영 트래픽을 최대한 반영하는 전용 평가 데이터셋이 필요하다. 프로토타이핑 단계에서는 사람이 직접 선별한 데이터셋을 사용하거나 실제 사용자 상호작용, 운영 로그, 시나리오를 테스트하기 위한 인공 생성 데이터 등으로 계속해서 확장해 나갈 수 있다.

-

개발 맥락 : 평가는 단순히 모델의 출력만 보는 것이 아니라, 데이터 증강(예, RAG), 에이전트 기반 워크플로우 등 전체 시스템 구성 요소를 포함해 분석되어야 한다. 이러한 접근법은 모든 구성 요소가 어떻게 상호작용하며 애플리케이션의 전체 성능에 기여하는지를 이해하는 데 도움이 된다.

-

좋은 성능에 대한 정의 : 전통적인 평가지표는 단 하나의 정답과의 일치를 기준으로 평가하기 때문에, 예상치 못한 해답을 부당하게 낮게 평가할 수 있다. LLM을 사용할 때는 이러한 문제를 피하기 위해 단순한 정답 유사도 기준을 넘어서, 비즈니스 목표를 반영한 데이터셋 수준의 기준이나 입력된 사용자 지침에 따라 출력의 핵심 요소를 포착하는 채점 기준(루브릭, rubrics)을 설정하는 것이 바람직하다.

애플리케이션 개발자가 LLM 성능을 평가할 수 있는 3가지 방법

- 전통적인 평가 방법 : 정량적인 지표를 사용하여 모델의 출력과 이상적인 응답을 비교한다. 이 방식은 객관적인 통찰을 제공하려 하지만, 창의적이거나 예상 밖의 출력에는 불리하여 정답이 여러 개인 생성 작업에는 제한적일 수 있다.

- 인간 평가 : 가장 신뢰할 수 있는 방법으로 여겨지며, 사람의 판단은 복잡한 생성 출력에 대해 정교한 평가를 제공한다.

- LLM 기반 자동 평가기 : LLM 기반 자동 평가기는 사람의 판단을 모방하려 하며, 확장성과 효율성을 갖춘 평가를 제공한다. 전통적인 계산 기반 방법과는 달리, 참조 데이터가 있든 없든 작동할 수 있다. 기본적인 설정에서는 작업(task), 평가 기준(criteria), 후보 응답들(candidate responses)을 제공하고(참조 응답이 있다면 포함), 자동 평가기는 이를 활용해 LLM 출력을 생성하고 분석하여 평가 결과를 제공한다. 자동 평가기는 최종 출력뿐만 아니라, 그 결정에 대한 근거(reasoning)도 사용자에게 설명할 수 있다.

- 일반적인 생성형 모델 외에도 보상 모델이나 판별 모델도 평가기에 사용될 수 있다. 무엇보다도 모든 측정 도구와 마찬가지로 자동 평가기도 보정이 필요하다.

- 메타 평가 : 자동 평가기 출력과 인간 판단을 비교하는 것. 평가기가 원하는 선호도에 맞춰 조정되었는지를 확인하는 과정이다. 이 보정은 보통, 모델 선호도 일치율이나 상관 계수와 같은 지표를 기반으로 수행되며, 평가 작업에 맞춰 조정된다. 메타 평가에서는 자동 평가기의 잠재적인 한계도 고려하는 것이 중요하다.

Accelerating inference

(추론 가속화) Kaplan 등의 연구에서 처음 제시된 LLM의 확장 법칙은 오늘날까지도 유효하다. 언어 모델의 크기는 지속적으로 커져왔으며, 이는 최근 몇 년간 모델의 품질과 정확도가 크게 향상된 주요 원인이 되었다. 그러나 파라미터 수가 증가할수록 품질은 좋아지지만, 이를 실행하는 데 필요한 계산 자원도 함께 증가하게 된다. 그래서 개발자들은 모델 사용자에게 제공하는 비용과 지연 시간을 줄이기 위해 여러 가지 효율화 방안을 연구해왔다. 모델을 서비스할 때 발생하는 시간, 비용, 에너지를 균형 있게 고려하는 것을 성능-비용 균형(cost-performance tradeoff)이라고 하며, 이는 사용 사례에 따라 조정이 필요하다.

LLM이 사용하는 주요 자원 LLM이 사용하는 두 가지 주요 자원은 다음과 같다.

- 메모리

- 연산 능력

추론 속도를 높이기 위한 기술은 주로 이 두 가지 자원에 집중한다. 또한 메모리와 연산 장치 사이의 연결 속도도 중요한데, 이 부분은 일반적으로 하드웨어의 제약을 받는다. LLM은 지난 몇 년 사이 수백만에서 수십억 개의 파라미터로 1000배 이상 커졌으며, 파라미터가 많아질수록

- 모델을 저장하는 데 필요한 메모리 크기

- 출력을 생성하는 데 필요한 연산량 모두 증가하게 되었다.

왜 추론 가속화가 중요할까? LLM이 점점 더 대규모 시스템이나 지연 시간이 매우 짧아야 하는 상황에 도입되고 있기 때문에 추론 성능을 최적화하는 방법을 찾는 것은 매우 중요한 연구 주제가 되었고, 그에 따라 많은 발전이 이루어지고 있었다. 이제 추론을 가속화하는 다양한 방법들과 그에 따른 몇 가지 트레이드오프(장단점 균형)를 살펴보게 될 것이다.

Trade offs

많은 추론 최적화 기법들은 여러 요소 간의 균형을 요구한다. 이러한 균형은 상황에 따라 조정 가능하며, 사용 목적과 요구사항에 맞춰 맞춤형 접근 방식을 설계할 수 있게 해준다. 앞으로 다룰 다양한 최적화 기법들도 이러한 트레이드오프 스펙트럼 어딘가에 위치해 있을 것이다.

예들 들어,

- 지연 시간(Latency) vs 품질(Quality)

- 비용(Cost) vs 정확도(Accuracy) 같은 요소들 사이에서 한 가지를 약간 포기하고 다른 요소를 개선하는 방식이다. 하지만 여기서 완전히 하나를 희생한다는 의미는 아니다. 단지 어떤 요소의 품질이나 속도, 비용에서 약간의 저하를 감수하면서 다른 중요한 요소에서 큰 향상을 얻는다는 의미이다.

The Latency vs Cost Tradeoff

모델 정확도의 아주 작은(혹은 거의 없는) 저하를 감수하면, 추론 속도와 비용을 크게 개선할 수 있다. 예를 들어

- 작은 모델을 사용해서 작업을 수행하면 계산이 빨라지고 비용이 줄어든다.

- 양자화(Quantisation)를 통해 모델의 파라미터 정밀도(precision)를 낮추면, 연산이 더 빠르고 메모리도 적게 사용된다.

이 트레이드오프를 접근할 때 중요한 점은 다음 두 가지를 구분하는 것이다.

- 이론적으로 품질이 저하될 가능성

- 실제로 그 모델이 그 작업을 잘 수행할 수 있는가(실용적인 수행 능력) 이 두 가지는 사용 사례(use case)에 따라 다르며, 많은 경우 실제 품질 저하 없이도 정확도를 크게 향상시킬 수 있다.

예를 들어, 모델에게 시키려는 작업이 간단한 작업이라면 작은 모델이나 양자화된 모델도 그 작업을 충분히 잘 수행할 수 있다. 즉, 모델의 파라미터 수를 줄이거나 정밀도를 낮췄다고 해서 그 작업에 대해 성능이 무조건 떨어지는 것은 아니다.

Output-approximating methods

Quantization(양자화)

LLM은 기본적으로 숫자 행렬들(모델의 가중치)로 구성되어 있다. 추론 과정(inference)에서 이 가중치들에 행렬 연산(matrix operation)을 적용하여 숫자 출력값들(활성화값, activations)을 생성한다. 양자화(Quantization)란, 가중치와 활성화값을 저장, 전달, 연산할 때 사용하는 숫자의 정밀도(precision)를 낮추는 과정이다. 일반적으로 가중치와 활성화 값은 32비트 부동소수점(floating-point)숫자로 표현되지만, 양자화를 적용하면 이를 8비트 또는 심지어 4비트 정수(integer)로 낮출 수 있다.

양자화의 주요 장점

- 메모리 사용량 감소

- 더 큰 모델을 같은 하드웨어에 탑재 가능

- 연산 중 데이터 전달 속도 향상

- 한 칩 내부 또는 여러 칩 간의 가중치 및 활성화값 전달 속도 개선

- 통신 지연(latency) 감소 = 추론 속도 향상

- 더 빠른 산술 연산 가능

- 일부 하드웨어(GPU, TPU)는 낮은 정밀도의 행렬 곱 연산을 더 빠르게 지원함

품질(정확도)에 미치는 영향

- 양자화로 인한 품질 저하는 경미하거나 아예 없을 수 있음

- 만약 품질 저하가 발생하더라도, 그 손실보다 성능 향상이 훨씬 더 클 수 있음

📌 예시:

Benoit Jacob 외 연구에 따르면,

- MobileNet SSD의 FaceDetection 작업에서

- 정확도 2% 감소로

- 2배 속도 향상을 달성했다고 보고함

양자화 적용 방식

- 추론 전용 양자화

- 훈련은 32비트로 하고, 추론 시에만 양자화 적용

- 양자화 인식 훈련

- 훈련 중부터 양자화를 모델이 고려하도록 학습

- 양자화로 인한 품질 저하를 일부 회복할 수 있음

최적의 품질/비용 균형을 위한 조정 요소

- 가중치와 활성화값에 대해 서로 다른 정밀도 선택

- 텐서에 양자화를 적용할 때 세분화 수준 조절

- 예 : 채널 단위(channel-wise) 또는 그룹 단위(group-wise)

증류(Distillation)

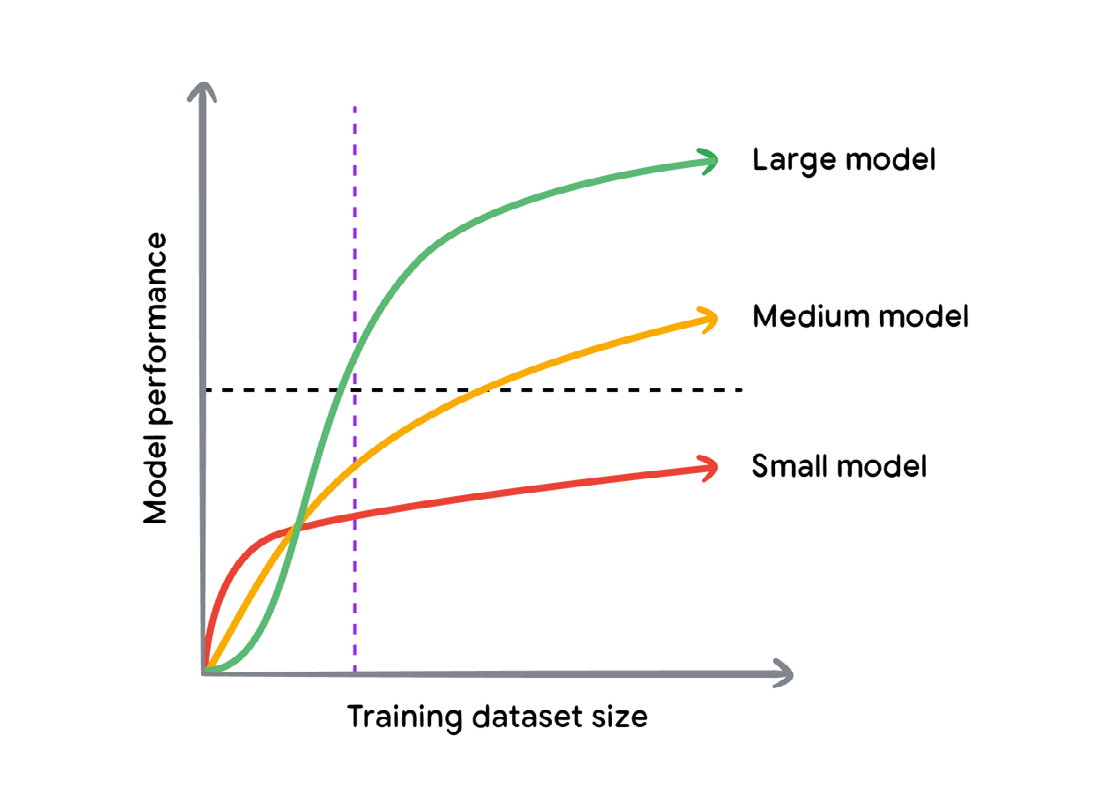

작은 모델을 사용하여 작업을 수행하는 것은 가장 효율적인 추론 최적화 기법 중 하나이다. 하지만 작은 모델은 더 큰 모델에 비해 품질 저하(regression)가 크게 나타날 수 있다. 증류(Distillation)는 이러한 문제를 해결하기 위한 일련의 훈련 기법으로 더 큰 모델을 사용하여 작은 모델의 품질을 향상시키는 것이 목적이다. 이 방식이 효과적인 이유는 같은 데이터로 훈련하더라도, 큰 모델이 작은 모델보다 훨씬 더 좋은 성능을 보여주기 때문이다. 그 이유는 주로 모델의 파라미터 용량과 학습 방식에 있다. 훈련 데이터셋의 양이 많아질수록, 이러한 성능 차이는 계속해서 벌어지는 경향이 있으며, 이는 아래 그림에서 보여주는 바와 같다.

데이터가 적은 경우에도?

놀라운 점은 훈련 데이터가 적을 때조차도, 큰 모델은 같은 데이터로 훈련된 작은 모델보다 더 나은 성능을 보여준다. 이 사실은 증류의 첫 번째 방식인 데이터 증류 또는 모델 압축 기법으로 이어진다.

방법(Method)

- 보유한 데이터로 훈련된 큰 모델을 사용해 추가적인 인공 데이터(합성 데이터, synthetic data)를 생성한다.

- 이 데이터를 사용하여 작은 모델을 훈련하면 원래 데이터만으로 훈련했을 때보다 성능이 더 향상된다.

단, 합성 데이터는 반드시 고품질이어야 하며, 그렇지 않을 경우 오히려 부정적인 효과를 초래할 수 있으므로 주의가 필요하다.

더 정밀한 수준의 증류 기법들

단순히 합성 데이터를 생성하는 것 외에도 더 세밀한 수준에서 Teacher와 Student를 가까워지게 하는 기법들도 존재한다.

지식 분류(Knowledge Distillation)

- Student 모델의 출력 토큰 분포를 Teacher 모델의 출력 분포와 맞추도록 학습하는 방식이다.

- 이 방법은 데이터 증류보다 더 적은 데이터로도 효율적인 학습이 가능하다는 장점이 있다.

온-폴리시 증류(On-policy Distillation)

- 강화학습 환경에서 Student 모델이 생성한 각 시퀀스에 대해 Teacher 모델이 피드백을 제공하며 학습을 돕는 방식이다.

Output-preserving methods

Flash Attention

Transformer 아키텍처에서 주로 사용되는 Scaled Dot-product Attention은 입력 길이에 대해 복잡도가 이차 함수인 연산이다. 따라서 Self-Attention 계산을 최적화하면 지연 시간과 비용 측면에서 큰 이점을 얻을 수 있다. Flash attention은 Tri Dao 등이 제안한 기법으로 어텐션 연산을 IO(입출력) 친화적으로 만들어 최적화한다. 구체적으로는 느린 고대역폭 메모리(HBM)와 빠른 메모리(SRAM/VEM)간의 데이터 이동을 최소화하는 데 중점을 둔다. 어텐션을 계산할 때, 연산 순서를 변경하고 여러 층을 한 번에 처리하여 빠른 메모리 계층을 최대한 효율적으로 활동할 수 있게 한다.

Flash Attention은 근사 알고리즘이 아니고 정확한 알고리즘이다. 즉 어텐션 계산의 숫자 출력값이 기존과 동일하게 유지하면서 빠르게 계산될 수 있도록 최적화된 알고리즘이라고 볼 수 있다.

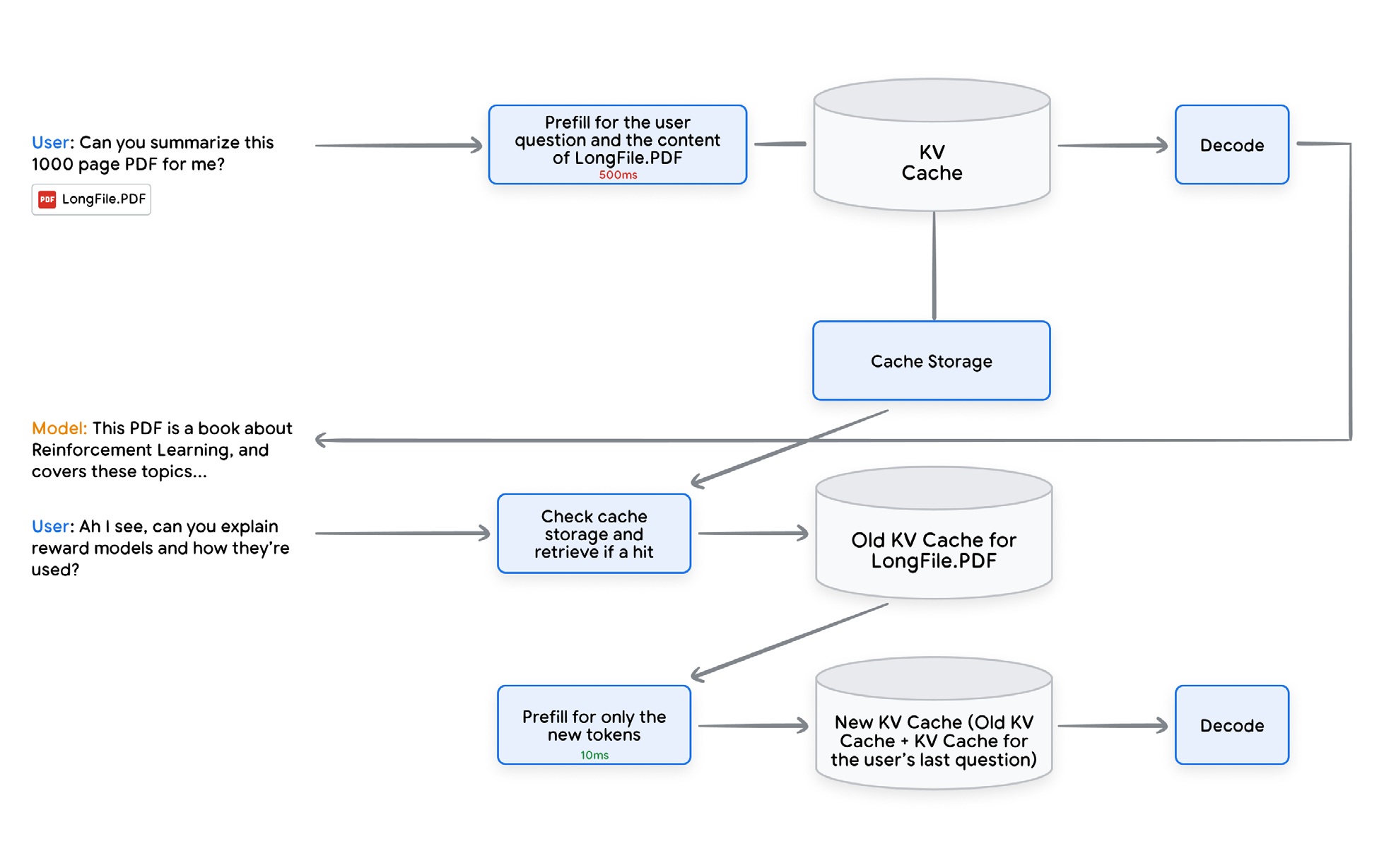

Prefix Caching

LLM 추론 과정에서 가장 연산량이 많고 느린 작업 중 하나는 입력에 대해 어텐션 키(key)와 벨류(Value)를 계산하는 작업이다. 이 작업은 보통 프리필(prefill)이라고 불린다. 프리필의 최종 결과물은 KV Chache인데, 이는 입력 전체에 대해 각 트랜스포머 층마다의 어텐션 키/벨류 값을 저장한 것이다. 이 KV Chache는 디코딩 단계(출력 토큰을 생성하는 과정)에서 매우 중요하다. 이 캐시 덕분에 오토리그레시브(autoregressive) 디코딩 중 입력에 대한 어텐션 점수를 매번 다시 계산하지 않아도 되기 때문이다.

프리픽스 캐싱이란? Prefix Chaching은 이전에 생성한 KV 캐시를 다음 추론 요청에서도 재사용하는 기법이다. 이렇게 하면 프리필 연산 시간과 비용을 줄일 수 있다. 이유 :

- Self-Attention 매커니즘에서는 토른이 자기 앞에 나온 토큰에만 주의를 집중하기 때문에, 이전 입력이 변하지 않았다면 그 계산 결과(KV Cache)를 재사용할 수 있다. 예를 들어, 새로운 입력이 기존 입력의 뒤에 덧붙는 형식이라면, 기존 입력에 대한 프리필 연산을 생략할 수 있다.

위의 그림을 기반으로 설명하면,

- 첫 번째 사용자 요청 : 전체 문서를 프리필해야 하므로 500ms 소요

- KV 캐시 저장 : 생성된 캐시는 저장됨(메모리 또는 디스크)

- 두 번째 사용자 요청 : 문서는 그대로이고, 질문만 바뀌었으므로, 기존 KV 캐시를 불러와 문서에 대한 재계산을 생략함 → 큰 연산 시간과 지연 시간 절감

프리픽스 캐시 사용 시 주의사항

- 입력 구조가 프리픽스 캐싱 친화적이어야 한다.

- 예를 들어, 매번 요청 시작 부분에 새로운 타임스탬프를 붙이면, 매번 프리픽스가 바뀌기 때문에 캐시가 무효화된다.

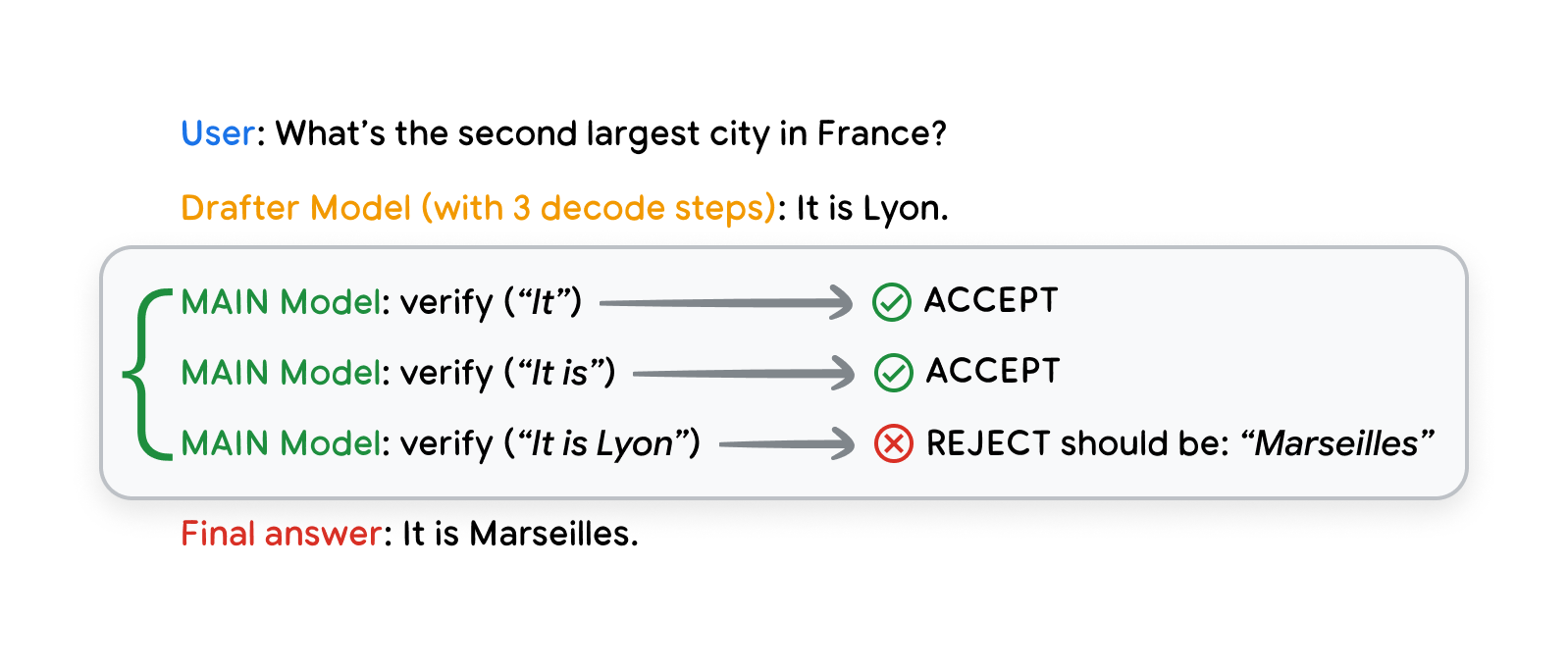

Speculative Decoding

LLM 추론 과정은 두 단계로 나뉜다.

- 프리필(prefill)

- 여러 토큰에 대해 대규모 행렬 연산이 병렬로 수행되며

- 계산 성능에 의해 제한된다.

- 디코드(decode)

- 토큰을 하나씩 순차적으로 생성해야 하므로,

- 메모리 성능에 더 큰 영향을 받는다.

디코딩은 토큰이 하나씩 순서대로 생성되어야 하므로 병렬로 속도를 높이기가 어렵다.(자기 자신 앞에 나온 토큰들만을 참조하는 Self-attention 구조 때문)

Batching and Parallelization

지금까지 소개한 최적화 기법들은 대부분 머신러닝, 특히 트랜스포머 아키텍처에 특화된 것이였다. 하지만 일반 소프트웨어 시스템과 마찬가지로, 처리량과 지연 시간을 줄이기 위해 다음 두 가지 방식의 조합을 활용할 수 있다.

- 계산량이 적은 작업들을 묶어(Batch) 처리하여 동일한 하드웨어에서 여러 요청을 동시에 처리함으로써 남는 연산 자원을 잘 활용하는 것

- 계산량이 많은 작업을 나눠서 병렬 처리하고 여러 하드웨어 인스턴스에 분산하여 더 많은 연산 능력을 확보하고 더 짧은 지연 시간을 확보

LLM에서의 배치 처리

- LLM에서는 특히 디코딩 단계에서 배치 처리가 매우 효과적이다.

- 디코드는 계산 자원에 의한 병목이 적기 때문에 여러 요청을 동시에 묶어 처리할 수 있는 여지가 많다.

- 다만, 주의해야 할 점은:

- 배치 처리가 남는 연산 자원을 잘 활용하는 방식으로 이뤄져야 한다는 것

- GPU나 TPU 같은 가속기에서 이를 구현할 수 있음

- 다키도이은 메모리 사용량이 큰 작업이기 때문에 너무 많은 요청을 배치하면 메모리 부족 문제가 발생할 수 있음

- 요즘은 고처리량 LLM 추론 시스템에서는 배치 처리가 핵심 구성 요소로 자리 잡고 있다.