Created at : 2024-06-26 11:21

Auther: Soo.Y

목차

- Autoencoder란?

- Autoencoder의 구성 요소

- Autoencoder의 학습 과정

- Autoencoder의 유형

- Autoencoder의 주요 응용 분야

- Autoencoder 구현 예제

- Autoencoder의 장단점

- 결론

1. Autoencoder란?

Autoencoder는 비지도 학습의 한 종류로, 입력 데이터를 압축하여 중요한 특징을 추출한 후 이를 다시 원래 데이터로 복원하는 신경망 모델입니다. 주로 데이터 차원 축소, 특징 추출, 노이즈 제거 등의 작업에 사용됩니다. Autoencoder는 데이터의 잠재 표현(latent representation)을 학습하며, 이 표현은 데이터의 주요 패턴을 반영합니다.

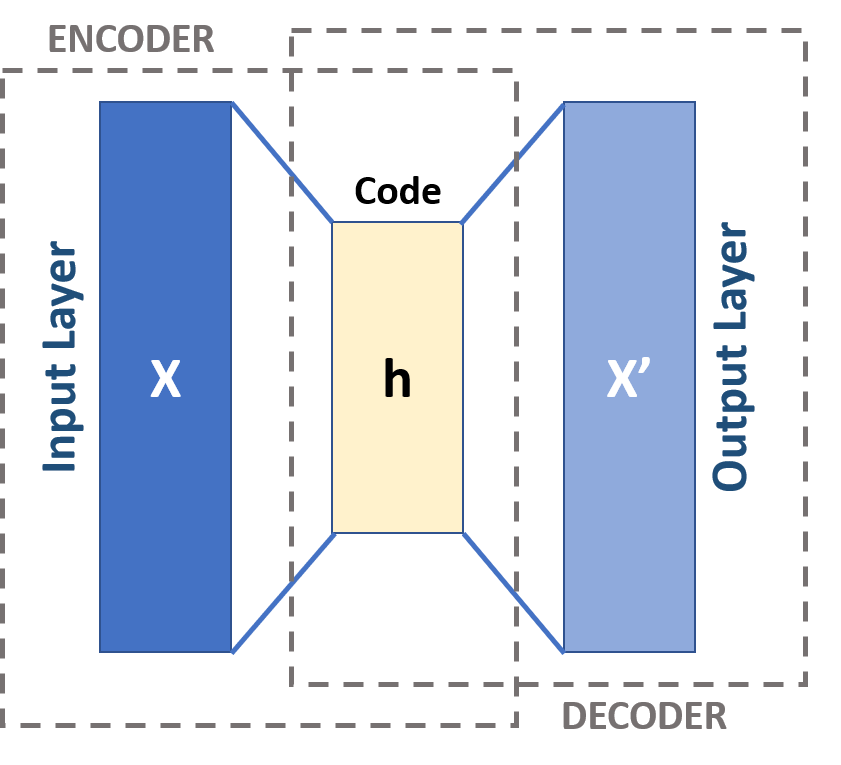

2. Autoencoder의 구성 요소

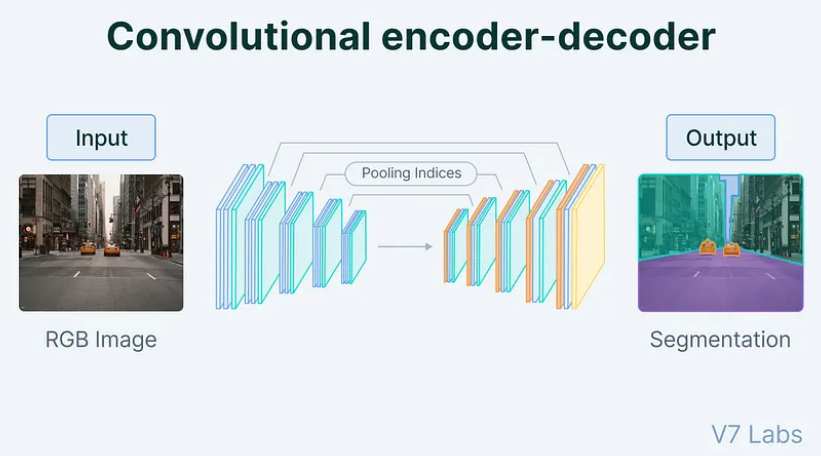

Autoencoder는 크게 인코더(Encoder)와 디코더(Decoder)로 구성됩니다.

- 인코더(Encoder): 입력 데이터를 저차원 잠재 공간(latent space)으로 압축합니다. 이는 데이터를 중요한 특징들로 변환하는 역할을 합니다.

- 디코더(Decoder): 인코더가 생성한 저차원 표현을 다시 원래의 고차원 공간으로 변환합니다. 이를 통해 원래의 데이터를 재구성(reconstruction)합니다.

3. Autoencoder의 학습 과정

Autoencoder는 입력 데이터를 그대로 출력으로 복원하는 방식으로 학습됩니다. 학습 과정은 다음과 같습니다.

- 입력 데이터를 인코더에 입력합니다.

- 인코더는 입력 데이터를 저차원 표현으로 변환합니다.

- 저차원 표현을 디코더에 입력하여 원래의 데이터로 복원합니다.

- 복원된 데이터와 원래 입력 데이터 사이의 오차(재구성 오류)를 최소화하도록 신경망을 학습시킵니다.

4. Autoencoder의 유형

Autoencoder에는 다양한 변형이 있습니다. 주요 유형은 다음과 같습니다.

- Vanilla Autoencoder: 가장 기본적인 형태의 Autoencoder입니다.

- Denoising Autoencoder: 입력 데이터에 노이즈를 추가한 후, 이를 제거하여 깨끗한 데이터를 복원합니다.

- Sparse Autoencoder: 일부 뉴런만 활성화되도록 하여 희소한 표현을 학습합니다.

- Variational Autoencoder (VAE): 확률적 접근을 통해 데이터의 잠재 표현을 모델링합니다.

5. Autoencoder의 주요 응용 분야

Autoencoder는 다양한 분야에서 활용됩니다. 주요 응용 분야는 다음과 같습니다.

- 데이터 압축: 데이터의 중요한 정보를 유지하면서 차원을 축소하여 저장하거나 전송할 수 있습니다.

- 노이즈 제거: 노이즈가 포함된 데이터를 학습하여 깨끗한 데이터를 생성할 수 있습니다.

- 특징 추출: 고차원 데이터에서 중요한 특징을 추출하여 다른 기계 학습 모델의 입력으로 사용할 수 있습니다.

- 이미지 생성: 새로운 이미지를 생성하는 데 사용할 수 있습니다. 특히 Variational Autoencoder는 이미지 생성에서 많이 사용됩니다.

6. Autoencoder 구현 예제

다음은 Pytorch를 사용하여 간단한 Autoencoder를 구현하는 예제입니다.

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms

from torch.utils.data import DataLoader

# 데이터 전처리 및 로드

transform = transforms.Compose([transforms.ToTensor(), transforms.Normalize((0.5,), (0.5,))])

train_dataset = datasets.MNIST(root='./data', train=True, download=True, transform=transform)

test_dataset = datasets.MNIST(root='./data', train=False, download=True, transform=transform)

train_loader = DataLoader(train_dataset, batch_size=256, shuffle=True)

test_loader = DataLoader(test_dataset, batch_size=256, shuffle=False)

# Autoencoder 모델 정의

class Autoencoder(nn.Module):

def __init__(self):

super(Autoencoder, self).__init__()

self.encoder = nn.Sequential(

nn.Linear(28 * 28, 128),

nn.ReLU(True),

nn.Linear(128, 64),

nn.ReLU(True),

nn.Linear(64, 32),

nn.ReLU(True)

)

self.decoder = nn.Sequential(

nn.Linear(32, 64),

nn.ReLU(True),

nn.Linear(64, 128),

nn.ReLU(True),

nn.Linear(128, 28 * 28),

nn.Sigmoid()

)

def forward(self, x):

x = self.encoder(x)

x = self.decoder(x)

return x

# 모델 초기화

model = Autoencoder()

criterion = nn.MSELoss()

optimizer = optim.Adam(model.parameters(), lr=0.001)

# 학습 함수 정의

def train(model, criterion, optimizer, train_loader, num_epochs=20):

for epoch in range(num_epochs):

for data in train_loader:

img, _ = data

img = img.view(img.size(0), -1)

output = model(img)

loss = criterion(output, img)

optimizer.zero_grad()

loss.backward()

optimizer.step()

print(f'Epoch [{epoch + 1}/{num_epochs}], Loss: {loss.item():.4f}')

# 학습 실행

train(model, criterion, optimizer, train_loader, num_epochs=20)

# 테스트 및 시각화

import matplotlib.pyplot as plt

def test(model, test_loader):

model.eval()

with torch.no_grad():

for data in test_loader:

img, _ = data

img = img.view(img.size(0), -1)

output = model(img)

break

img = img.view(img.size(0), 1, 28, 28)

output = output.view(output.size(0), 1, 28, 28)

return img, output

# 원본 이미지와 재구성 이미지 시각화

original, reconstructed = test(model, test_loader)

fig, axes = plt.subplots(1, 2)

axes[0].imshow(original[0].squeeze(), cmap='gray')

axes[0].set_title('Original Image')

axes[1].imshow(reconstructed[0].squeeze(), cmap='gray')

axes[1].set_title('Reconstructed Image')

plt.show()7. Autoencoder의 장단점

장점:

- 데이터의 중요한 특징을 추출하고 차원을 축소할 수 있습니다.

- 비지도 학습으로 라벨이 없는 데이터에서도 학습이 가능합니다.

- 노이즈 제거와 데이터 압축에 효과적입니다.

단점:

- 복잡한 구조의 데이터를 복원하는 데 한계가 있을 수 있습니다.

- 학습 시간이 오래 걸릴 수 있습니다.

- 지나치게 단순한 구조일 경우 유용한 특징을 제대로 학습하지 못할 수 있습니다.

8. 결론

Autoencoder는 데이터의 잠재 표현을 학습하여 차원 축소, 노이즈 제거, 특징 추출 등의 작업에 효과적으로 사용할 수 있는 강력한 도구입니다. 다양한 변형을 통해 여러 응용 분야에서 활용할 수 있으며, 특히 딥러닝 기반의 비지도 학습 모델로서 중요한 역할을 합니다. Autoencoder를 이해하고 활용하는 것은 딥러닝 모델링 능력을 향상시키는 데 큰 도움이 됩니다.